1.機械学習と脳の違い Part 2: パーセプトロンとニューロンの情報処理方法の違いまとめ

・人工的なパーセプトロンと生物学的なニューロンは情報伝達方法が根本的に異なる

・ニューロンは情報の到着順によって異なる反応をするがパーセプトロンはそれができない

・これにより生体ニューロンを人工パーセプトロンモデルに確実に実装することはできない

2.パーセプトロンとニューロンの違い

以下、www.kdnuggets.comより「Machine Learning Is Not Like Your Brain Part Two: Perceptrons vs Neurons」の意訳です。元記事は2022年5月24日、Charles Simonさんによる投稿です。

このシリーズ、脳の働きの解説としてとても興味深く参考になるのですが、個人的には結論の部分に少し同意しかねる部分があります。

すなわち、有名な「人間は鳥のようにはばたく事が出来ないから空は飛べない議論」のように、前半部分は正しくあっても後半部分は(飛行機等の代替手段で空は飛べるので)解釈の余地があります。

機械学習は人間の脳と同じ仕組みではありませんが、人間の脳と同じ仕組みでなければ人間の脳が出来る事が出来ないと断言するにはまだ時期尚早かなと思っています。

実際、本文内に出てくるボール・ニューロンって実は機械学習の世界でもスパイダーマン・ニューロンという同等なものが出現する現象が既に確認されています。

そして仮に人間の脳と同じ仕組みを構築して、そのシステムが人間同等の能力を実現したとしてもLamdaと同様にそれを証明する事が出来ないのではないかな、と思います。

アイキャッチ画像はlatent diffusionで脳とパーセプトロンを表現しようとしてやっぱり上手くプロンプトエンジニアリングが出来なかった画像

現在の人工知能(AI:Artificial Intelligence)は驚異的な能力を発揮していますが、その機能は、人間の脳が同じタスクを達成するために働く方法とはほとんど関係がありません。AI、特に機械学習(ML:Machine Learning)は、膨大なデータセットを分析し、処理中のデータを理解せずにパターンや相関関係を探すことで機能します。その結果、タグ付けされた何千ものサンプルを必要とするMLシステムは、タグ付けされていないわずかなデータから学習できる子供の心とは根本的に異なっています。

現在のAIがこのような固有の限界を克服し、次の段階(汎用人工知能)へと進化するためには、すでに汎用知能を実装している脳とその人工物との違いを検討する必要があります。

この9回シリーズでは、このような観点から、生物学的なニューロンの能力と限界、そしてそれらがMLとどのように関連しているかを、順次詳しく検証していきます。第1回では、ニューロンの速度が遅いために、何千もの学習サンプルを使って学習する方法がいかにありえないかを検証しました。第二部では、パーセプトロンの基本的なアルゴリズムと、スパイクを伴う生物学的ニューロンのどのモデルとも異なる点について見ていきます。

多くのMLアルゴリズムの基礎となるパーセプトロンは、生物学的なニューロンモデルとは根本的に異なります。パーセプトロンは、シナプスを介して入力される信号の和の関数として計算された「値」を持ち、その各信号はシナプスの重みとその出所のパーセプトロンの値の積となります。一方、生体ニューロンは、ある閾値に達するまで時間をかけて電荷を蓄積するので、わずかながら記憶を持ちます。

同様に、パーセプトロンがアナログ値を持つのに対して、ニューロンは単にスパイクを放出するだけです。パーセプトロンは記憶を持ちませんが、ニューロンは記憶を持ちます。パーセプトロンのアナログ値はニューロンのスパイク速度に似ていると言われますが、パーセプトロンはスパイクのタイミングや入力信号の位相は無視し、周波数だけを意識するので、この例えは破綻しています。その結果、生物学的なニューロンはスパイクの到着順序によって異なる反応をすることができますが、パーセプトロンはそうすることができません。

図解します。

シナプスはニューロンの内部電荷に影響を与えます。します。正の重みを持つシナプスは蓄積された電荷が閾値(1として定義)を超えたときに発火するように刺激し、負の重みを持つシナプスは発火を抑制します。

重みが 0.5 と -0.5 の 2 つの入力によって刺激されるニューロンを考えましょう。入力の順序が 0.5, -0.5, 0.5, -0.5 の場合、ニューロンは決して発火しません。なぜなら、正の入力の後に負の入力が続き、蓄積された電荷がゼロになるからです。入力が 0.5, 0.5, -0.5, -0.5 の順序で発火すると、ニューロンは 2 番目の正の重みを持つスパイクの後に発火します。

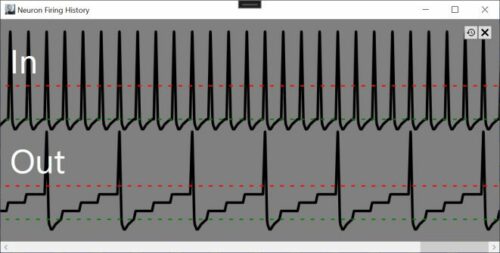

0.25の重さで刺激されたニューロン(Out)が電荷を蓄積し、入力ニューロン(In)の4回目の入力スパイクごとに発火する様子を図解しています。

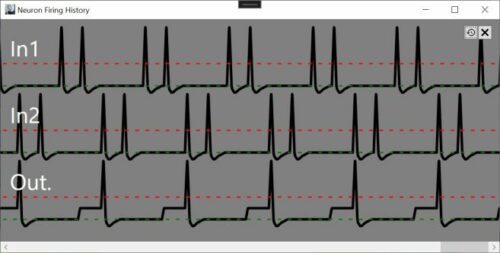

In1とIn2がそれぞれ0.5と-0.5の重みで刺激する場合、Outは決して発火しません。

しかし、入ってくるスパイクのタイミングを変えることで、Outを発火させることができます。パーセプトロンモデルは、入ってくる信号のタイミングや位相を無視するため、この機能をサポートしていません。

どちらの場合も、平均入力頻度は0.5(最大発火率の半分)です。パーセプトロンモデルはどちらの場合でも同じ出力0を与えます。なぜなら、重み付けされた入力の和、つまり0.5*0.5 + 0.5*-0.5 は、入力タイミングに関わらず常に0となるからです。つまり、人工パーセプトロンモデルを生体ニューロンに確実に実装することはできず、その逆もまたしかりなのです。

これは人工ニューラルネットワークと生物学的ニューロンとの本質的な違いなので、今日のAIを非常に根本的なレベルで脳の機能とは異なるものにしている他の生物学的要素とともに、別の記事を割いて探求することにします。

生物学的ニューロンモデルは、単一のスパイクに意味を持たせることができます。脳のニューロンの圧倒的多数はまれにしかスパイクしないので、多くのニューロンは特定の意味を持っていると思われます。例えば、あなたはボールが何であるかを理解しているので、あなたの脳には、ボールを見たりその言葉を聞いたりすると発火する一つの(またはおそらく多数の)「ボール・ニューロン」があると思われます。

生物学的なモデルでは、このニューロンはボールを認識したときに一度だけ発火するかもしれません。しかし、パーセプトロンの発火率モデルでは、1回のスパイクの発火率が定義されていないため、このようなことは起こりえません。

次回は、脳の結合がMLの整然とした層で構成されていないこと、そのために基本的なパーセプトロンのアルゴリズムに何らかの修正が必要で、バックプロパゲーションが全く機能しない可能性があることについて述べたいと思います。

3.機械学習と脳の違い Part 2: パーセプトロンとニューロンの情報処理方法の違い関連リンク

1)www.kdnuggets.com

Machine Learning Is Not Like Your Brain Part Two: Perceptrons vs Neurons