1.Open Images V6:新しいタイプの注釈localized narrativesが特徴(2/2)まとめ

・Open Images V6では、視覚的関係の注釈の種類を1桁(約1.4k)増やした

・個々のアクションを実行する人間を含んだ250万の注釈も増やした

・2350万の人間が検証した新しい画像レベルのラベルも追加した

2.Open Images V6の収録データ数

以下、ai.googleblog.comより「Open Images V6 — Now Featuring Localized Narratives」の意訳です。元記事の投稿は2020年2月26日、Jordi Pont-Tusetさんによる投稿です。アイキャッチ画像のクレジットはPhoto by Anthony Tran on Unsplash

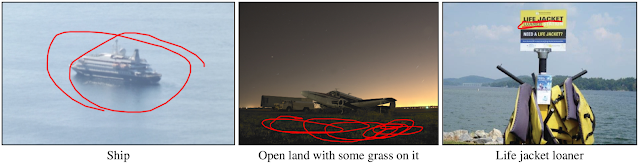

話ながら同時に指さすことは非常に直感的な操作であるため、注釈作業者にはlocalized narrativesを作成するタスクに関して非常に曖昧な指示を与える事になりました。これは、人々がどのように画像を描写するかを研究するための潜在的な方向性を作り出しました。例えば、物体の空間範囲を示す際にさまざまなスタイル(円形状、範囲を引っ掻く、下線を引くなど)を観察しました。これらの研究は、新しいユーザーインターフェイスの設計に貴重な洞察をもたらす可能性があります。

画像下部の単語に対応する様々なマウスの動き

画像ソース:

Elliott Brownによる「Via Guglielmo Marconi, Positano – Hotel Le Agavi – boat」

vivek jenaによる「air frame」

Virginia State Parksによる「CL P1050512」

これらの追加されたlocalized narrativesのデータの量を規模感は、マウスの動きを合計すると地球の半径にほぼ等しい6400 kmであり、音声を停止せずに読み続けると、全てを聞くのに約1.5年かかる程です!

新しい視覚的関係、人間の行動、画像レベルの注釈

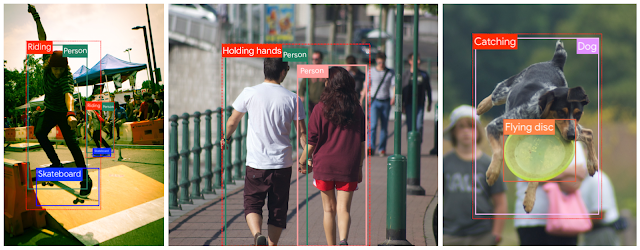

localized narrativesに加えて、Open Images V6では、視覚的関係の注釈の種類を1桁(約1.4k)増やしました。例えば、「スケートボードに乗る男」、「手をつないでいる男と女」、「フライングディスクをキャッチする犬」を追加しています。

画像ソース

James BuckのIMG_5678.jpg

Quentin MeulepasのDSC_0494

sally9258のDSC06464

画像内に写っている人々は、多くのアプリケーションにとって最も重要であり、人々が一体何をしているかを理解する事はコンピュータービジョンタスクの関心の中心です。Open Images V6に、「ジャンプ」、「笑顔」、「横たわる」などの個々のアクションを実行する人間を含んだ250万の注釈も含まれているのはこのためです。

Boo Phによる_DSCs1341(2)

JohannesGärtnerによるRichard Wagner Spiele 2015

最後に、2350万の新しい人間が検証した画像レベルのラベルも追加しています。これにより、約20,000に渡るカテゴリで画像数は合計5990万に達しました。

結論

Open Images V6は、画像分類、オブジェクト検出、視覚的関係検出、インスタンスセグメンテーションなどを統合し、注釈を改善するための重要な定性的および定量的ステップです。視覚と言語をlocalized narrativesに接続する新しいアプローチを採用しています。Open Images V6が、風景の真の理解に向けた進歩をさらに刺激することを願っています。

3.Open Images V6:新しいタイプの注釈localized narrativesが特徴(2/2)関連リンク

1)ai.googleblog.com

Open Images V6 — Now Featuring Localized Narratives

2)storage.googleapis.com

Open Images Dataset V6 + Extensions