1.stable diffusionに自分の好きなキャラクターを描いてもらう事は出来るのか?まとめ

・stable diffusionが既に内部的に概念を確立しているキャラクターは描いてもらうのは簡単

・そのキャラクターを認識していない場合はtextual inversionで概念を持ち込む事ができる

・しかし概念同士がバッティングすると上手くいかないので工夫をする事が大切になる

2.もちろんスタジオジブリの風の谷のナウシカに挑戦だ!

アイキャッチ画像はstable diffusionのtextual inversionを使った生成時にパラメータ変更等の試行錯誤をしている際に出来たAI Artな感じの画像集。

2022年10月3日追記)textual inversionの上位互換とも言えるDreamBoothという手法が発表されているのでそちらも見ておくと良いと思います。

結論から書きますと、stable diffusionが既に内部でそのキャラクターを特定の単語と結びつけて認識している場合は非常に簡単でストレートにそのキャラクター名をプロンプトに書けばよいです。ですが、そのキャラクターを認識していない場合、もしくは認識していても単語との結びつきが弱い場合は難度が跳ね上がります。超頑張って独自データでstable diffusionを微調整するなり、昨日の投稿のようにtextual inversionで工夫する事が必要になるのではないかと思っています。

昨日投稿した「Stable Diffusionに天空の城ラピュタの飛行石の紋章を描いて貰う」でも書きましたが、当然の事ながら飛行石の前にナウシカで散々試行錯誤しており、まだ満足するレベルの画像が出来ていません。

しかし、経験則ではありますが、私と同様にtextual inversionで悩んでいる人向けにヒントになるかもしれないので、試行錯誤の際に感じた事を以下に書いておきます。

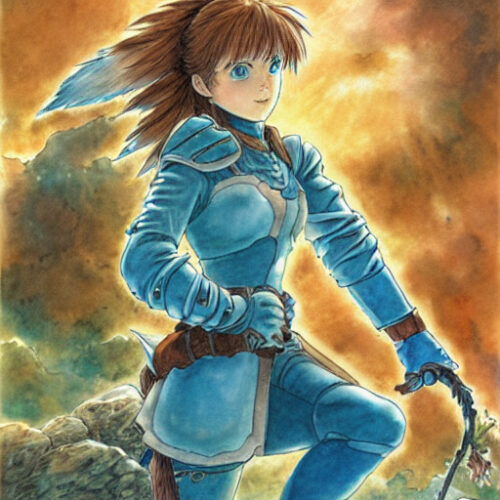

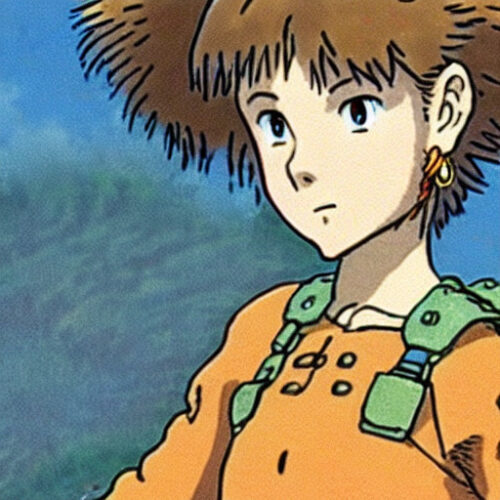

(1)スタイルとして取り込むのは比較的容易

|

|

|

|

|

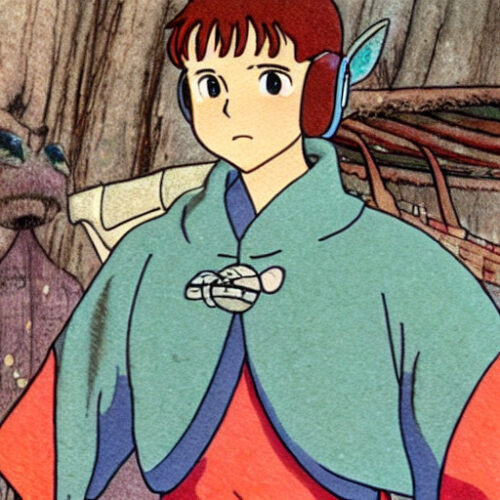

上記はtextual inversionでstyleとしてナウシカを取り込んだ際の生成画像です。顔や全体的な雰囲気はナウシカに全く似ていませんが、髪の色、服の色、戦闘装備である事、などのスタイルは見事に捉えていると感じます。

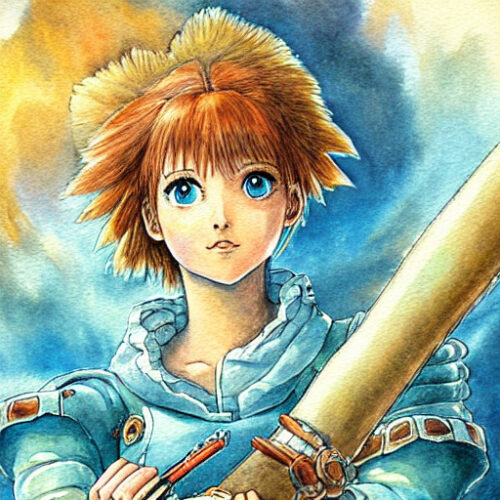

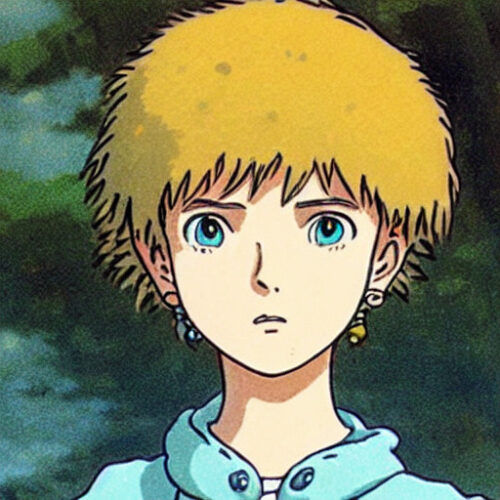

(2)オブジェクトとして取り込むのは難度が高い

|

|

|

|

|

上記はtextual inversionでobjectとしてナウシカを取り込んだ際の生成画像。上記は相当な枚数の中から真心を込めて人力で厳選した結果です。それでも「やや目鼻立ち部分に雰囲気が出ているかな?」レベルであり、「えー、全然似てない!」という意見は全面的に賛同します。

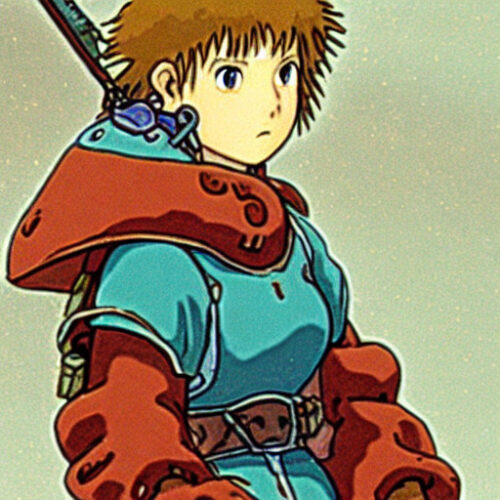

まぁ、普通に画像を生成していても人の顔面って崩れがちなので、人物は難しいのかな、と考え、ここで一旦対象をラピュタのロボット兵にしてみました。

|

|

|

|

ところが、これでもやはり「オブジェクト」として取り込む事がうまくできておらず、上記のように「一般的なロボットの概念にロボット兵のスタイルが転移された画像」が量産される事になります。特に右端の画像は、手足や顔はちゃんとロボット兵になっているのですが、全体として似ても似つかないものになっているという面白くはありますが、望みの絵を描いてほしい立場からは非常に厄介な現象です。

この後、かなり悩んだ末に「取り込みやすい概念と取り込みにくい概念がある」という仮説を立てて、作ったのが昨日の飛行石の紋章です。概念同士をバッティングさせないようにする工夫をするか、バッティングせずに良い感じになってくれる事を祈って大量に生成する事が必要なのではないかと考えています。前者がラピュタの飛行石であり、後者が今回のナウシカです。

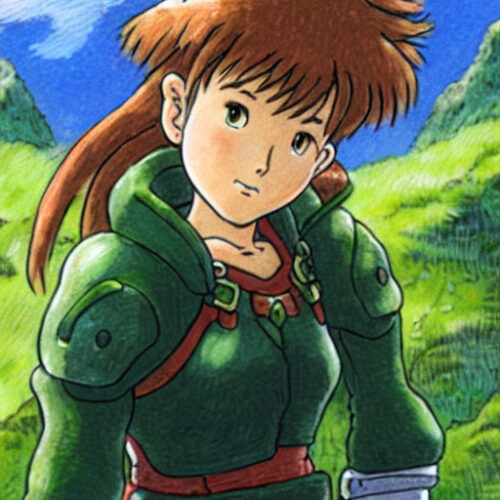

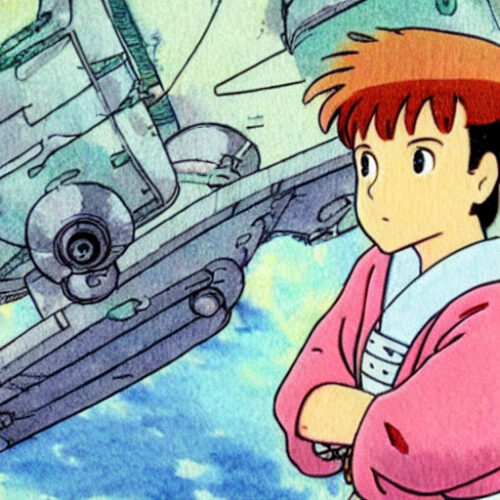

上記を念頭にその後も試行錯誤は進めて、ナウシカとは言い難いですが、かなりジブリキャラに雰囲気を寄せた画像が徐々に出来るようになってきています。しかし、下記も相当な枚数の中から真心を込めて人力で厳選した結果なので、秘密のプロンプトを発見したわけではなく「とにかく量!大量の枚数を生成する事」が現時点の私なりの回答で、正直この部分はチューニングとは言い難い状況です。

|

|

|

|

|

すっごい沢山の画像を生成すると、中には「着物を着たナウシカ」と言い張る事も出来そうな画像が出来るような事もありますが、再現性はとても低いです。もう少し確度を上げるためにはよりディープな世界に入っていかねばならないのだろうな、と思っています。