1.DALL·E:文章から画像を作成(1/3)まとめ

・自然言語で記述した様々な概念を参考にして画像を作成する事ができるDALL·EをOpenAIが発表

・DALL·Eは、テキストと画像のペアを使用して訓練されたGPT-3の120億パラメータ版

・動物や物体の擬人化画像、関連がない概念同士を妥当な方法で組み合わせる事などが可能

2.DALL·Eとは?

以下、openai.comより「DALL·E: Creating Images from Text」の意訳です。元記事の投稿は2021年1月5日、Aditya Rameshさん、Mikhail Pavlovさん、Gabriel Gohさん、Scott Grayさん、Mark Chenさん、Rewon Childさん、Vedant Misraさん、Pamela Mishkinさん、Gretchen Kruegerさん、Sandhini Agarwalさん、Ilya Sutskeverさん、Justin Jay Wangさんによる投稿です。

2022年4月追記)後続研究であるDALL·E 2が発表されています。

2022年6月追記)DALL·Eのオープンソース版であるDALL·E miniが発表されています。

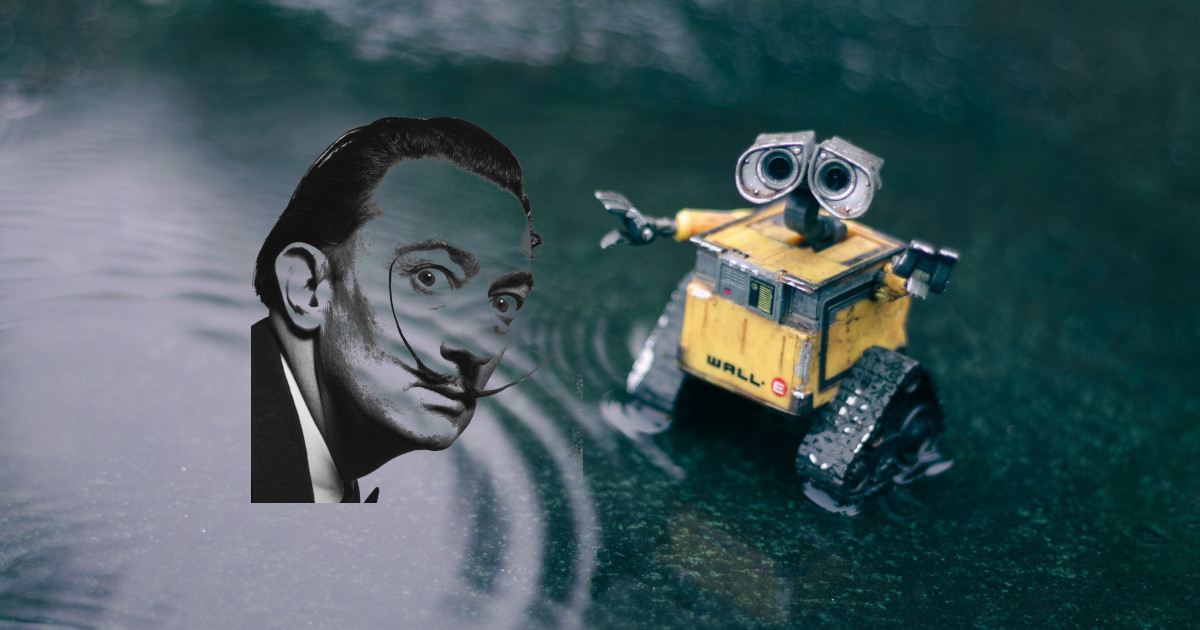

アイキャッチ画像は元ネタの一つであるWALL-EのフィギュアでクレジットはPhoto by Erik Mclean on Unsplash、それにWebBigDataがダリの顔を合成

DALL·Eと呼ばれるニューラルネットワークをトレーニングしました。DALL·Eは自然言語で記述した様々な概念を参考にして画像を作成する事ができます。

DALL·Eは、テキストと画像のペアのデータセットを使用して、テキストで書かれた説明文から画像を生成するようにトレーニングされたGPT-3の120億パラメータ版です。動物や物体の擬人化バージョンの作成、関連がない概念同士を妥当な方法で組み合わせる事、テキストのレンダリング、既存の画像の変換ど、様々な機能が備わっていることがわかりました。

芸術家のサルバドール・ダリ(Salvador Dalí)とピクサーのアニメ「ウォーリー(WALL-E)」から名前を借りてDALL·Eと名付けました。

(スマートフォンの場合はフリックで左右にスライドできます)

GPT-3は、言語を使用して、様々な文章を生成するように大規模なニューラルネットワークに指示できることを示しました。iGPTは、同じタイプのニューラルネットワークを使用して真に迫った画像を生成できることを示しました。これらの調査結果を拡張して、言語を介した視覚的概念の操作が現在到達可能になった事を示します。

概要

GPT-3と同様に、DALL·Eはtransformerを使った言語モデルです。テキストと画像の両方を最大1280個のトークンを含むデータの単一ストリームとして受信し、最尤法を使用してすべてのトークンを次々に生成するようにトレーニングされます。

このトレーニング手順により、DALL·Eは画像をゼロから生成するだけでなく、入力テキストの指示に従って、既存の画像の長方形領域を右下隅まで伸ばして再生成することもできます。

DALL·Eのような生成モデルを含んだ研究は、重大で幅広い社会的影響を与える可能性があることを私達は認識しています。将来的には、DALL·Eのようなモデルが、社会問題にどのように関連するかを分析する予定です。これらの社会問題には特定の業務や職業への経済的影響、モデル出力に偏見が含まれる可能性、このテクノロジーによって暗示される長期的な倫理的課題などが含まれます。

DALL·Eの機能

DALL·Eは、多種多様な文を元に、もっともらしい画像を作成できることがわかりました。言語の構成構造を探求するような様々な言い回しにも対応できます。以下のセクションでは、一連の指示に基づいて作成された画像を使用してこれを説明します。画像を説明する文章とその下に表示されるサンプル画像は、CLIP(訳注:DALL·Eと同時に発表されたOpenAIの新モデル。文章を教師データにして画像概要を効率的に学習できる)で再ランク付けした後、全512中の上位32までを表示しています。サムネイル画像を除いて、手動で見栄えの良い画像を選択する事はしていません。

属性の制御

物体属性をいくつか変更し、DALL·Eの機能と、物体が表示される回数をテストします。

(スマートフォンの場合はフリックで左右にスライドできます)

複数の物体の描画

複数の物体、それらの属性、およびそれらの空間的関係を同時に制御することは、新たな課題を提示します。例えば、「赤い帽子、黄色の手袋、青いシャツ、緑のズボンを身に着けているハリネズミ」というフレーズを考えてみましょう。この文を正しく解釈するには、DALL·Eは動物と服装の各部分を正しく構成するだけでなく、それらを混同することなく関連付け(帽子を赤に)、(手袋を黄色に)、(シャツを青に)、および(パンツを緑に)を形成する必要があります。

相対的な配置、物体の積み重なり、および複数の属性の制御について、これを行うDALL·Eの機能をテストしました。

(スマートフォンの場合はフリックで左右にスライドできます)

DALL·Eは、少数の物体の属性と位置をある程度制御できますが、成功率は、画像を説明する文章の表現方法によって異なります。より多くの物体が記述されると、DALL·Eは物体とその色の間の関連付けを混乱してしまう傾向があり、成功率は急激に低下します。また、DALL·Eは、こういった難しいケースにおける文章の言い換えに関して脆弱であることに注意してください。意味的に同等であっても違った言い回しの文章では、正しい解釈が得られないことがよくあります。

3.DALL·E:文章から画像を作成(1/3)関連リンク

1)openai.com

DALL·E: Creating Images from Text

・「犬の散歩をする」「バレリーナ用衣装を着た」「大根の赤ちゃん」のイラスト

・「アボカド」の「形状」をした「アームチェア」

・「openai」と書かれた「店頭」

・上段の「猫画像」と全く同じものを「スケッチ風」にして下段に