1.対照学習で最良のビューを選択するための原則(1/2)まとめ

・異なる角度から物体をみても、それが同じ物体である事を認識するのは機械にとって困難

・これを実現する主な手法は対照学習と言いラベル付きデータを必要としない自己教師型

・InfoMin仮説は対照学習のパフォーマンスを底上げするために必要な条件を探った仮説

2.InfoMin仮説とは?

以下、ai.googleblog.comより「Understanding View Selection for Contrastive Learning」の意訳です。元記事の投稿は2020年8月21日、Yonglong TianさんとChen Sunさんによる投稿です。

未読でしたら以下も読んでおいた方が良いです。

SimCLR:対照学習により自己教師学習の性能を向上

本文中に出てきたパンダ画像を見てパンダって本当に垂れるんだな、と感銘を受けつつ対照的を意図しているような気もするアイキャッチ画像のクレジットはPhoto by Pascal Müller on Unsplash

ほとんどの人は、異なる角度から物体をみても、それが同じ物体である事を当然のように認識できます。

正面から見て犬であれば、横から見た場合も犬です。

人間は自然にこれを行う事ができますが、機械には同じ事ができません。これを実現するためにコンピュータ科学者は、機械が視点(ビュー)の変化の影響を受けないような特徴表現、つまり実務的な視覚タスクを実行するために必要な堅牢なデータ表現を学習できるようにする必要があります。

もちろん、こういった特徴表現を学習するために、手動でラベル付けしたトレーニングデータを使用する事もできます。しかし、多くの場合、そのようなラベル付けデータはコストや手間がかかるので利用できません。

そのため、手動でラベル付けしたトレーニングデータを必要としない自己教師アプローチ、およびクロスモーダル(訳注:2つ以上の異なる知覚を組み合わせる)な教師アプローチへのニーズが発生します。

現在、そのようなデータを使用したトレーニングの一般的なパラダイムは、「対照的なマルチビュー学習(contrastive multiview learning)」です。

同じシーン(例えば、画像とその画像の色合いを変換した画像のペア、画像とその画像を水増しした画像のペア、ビデオとそのビデオを説明するテキストのペアなど)を見ている2つのビューは特徴表現空間で収束する傾向がありますが、異なるシーンを見ている2つのビューは発散する傾向があります。

このアプローチの成功にもかかわらず、1つの重要な質問が残っています。

「ラベル付きデータをすぐに利用できない場合、特徴表現を不変にするビューをどのようにして選択しますか?」

言い換えれば、画像内に存在する画素情報を使用して物体を識別しつつ、その画像が異なるビューから見られた時も同一物体である事を認識するためにはどうすれば良いでしょうか?

論文「What makes for good views for contrastive learning」では、ビュー選択の重要性をよりよく理解するために理論的および経験的分析を使用します。また、タスクに関連する情報をそのままにしつつ、ビュー間の相互情報(mutual information)を減らす必要がある事を主張します。

この仮説を検証するために、相互情報量を減らすことを目的とした効果的なビューを学習する教師なしフレームワークと半教師付きフレームワークを考案します。

また、相互情報量を削減する方法としてデータ水増しを検討し、データ水増しが実際に相互情報量を減らし、下流タスクの分類精度を向上させることを示します。この分野でのさらなる研究を促進するために、コードと事前トレーニング済みモデルをgithubでオープンソースとして公開しています。

InfoMin仮説

対照的なマルチビュー学習の目的は、パラメトリックエンコーダー(parametric encoder)を学習することです。パラメトリックエンコーダーの出力する特徴表現を使用して、「同じIDを持つビューのペア」と「異なるIDを持つビューのペア」を区別できます。

ビュー間で共有される情報の量と種類によって、最終的なモデルが下流タスクでどの程度適切に動作するかが決まります。

私達は、最良の結果が得られるビューでは、タスクに関連する情報(オブジェクトラベルなど)を除いて、入力内の情報をできるだけ多く破棄する必要があると仮定しており、これをInfoMin原則と呼んでいます。

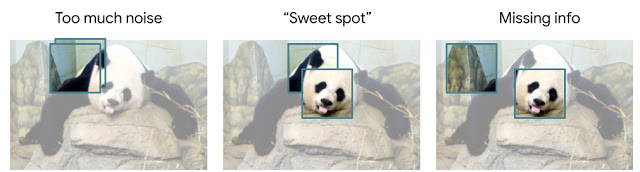

同じ画像内の2つの範囲が「異なるビュー」を表現している以下の例を検討してください。トレーニングの目的は、2つのビューが同じ画像に属していることを識別することです。

例えば、左図のような、あまりにも多くの情報を共有するビューを持つことは望ましくありません。色や質感などの低次元の手がかりを使ってズルができてしまいます。また、右図のようにビューが同じ画像に属していることを識別するには情報が少なすぎる事も望ましくありません。

それより、中央の「スイートスポット」のビューは、下流タスクに関連する情報を共有します。例えば、物体分類タスク用にパンダの様々な部位に関する範囲です。

対照的なマルチビュー学習の際に取得された3つの情報の図

左図:ビューが共有する情報は多すぎます。

右図:少なすぎます

中央図:下流タスクのパフォーマンスを最大化する最適な組み合わせ(スイートスポット)

3.対照学習で最良のビューを選択するための原則(1/2)関連リンク

1)ai.googleblog.com

Understanding View Selection for Contrastive Learning

2)arxiv.org

What makes for good views for contrastive learning

Representation Learning with Contrastive Predictive Coding

3)github.com

PyContrast/pycontrast/

コメント