1.Seq2act:機械学習でスマホ操作を人間の代わりに実行する(1/2)まとめ

・スマートフォンの機能の多くはユーザーが簡単に発見したり使いこなす事ができず不便

・自然言語で書かれた操作指示を端末操作に変換し自動で端末を操作してくれるAIが望まれる

・一連の指示が与えられた時に「スマホ上で実行すべき一連のアクション」を予測するモデルが公開

2.スマホの操作指示を自動実行する試み

以下、ai.googleblog.comより「Grounding Natural Language Instructions to Mobile UI Actions」の意訳です。元記事の投稿は2020年7月10日、Yang Liさんによる投稿です。

今回のお話で説明されている機能は、スマートフォンの操作に困難を覚える方にとても望まれる機能だと思うのですが、それこそ動物やロボットなどがスマートフォンを使いこなすきっかけにもなりますね。

アイキャッチ画像は操作指示を受けているエージェントでクレジットはPhoto by Velizar Ivanov on Unsplash

モバイルデバイスは、日常の活動を支援する無数の機能を提供します。

しかしながら、これらの機能の多くはユーザーが簡単に発見したりアクセスしたりすることができません。ユーザーに特定のタスクの実行方法(Googleマップで交通状況表示モードをオンにする方法やYouTubeの通知設定を変更する方法など)を調べる事を強いています。

これらの詳細な手順をWebで検索することもできますが、これらの手順を順番に実行し、細かいユーザインタフェースを小さなタッチスクリーンで操作するのはユーザーの責任です。これは退屈で時間がかかる可能性があり、アクセシビリティの低下に繋がります。

これらの自然言語で書かれた指示を端末操作に変換し、ユーザーに代わって自動的に端末を操作してくれる計算エージェント(computational agents)を設計できるとしたらどうでしょうか?

ACL 2020で公開された論文「Mapping Natural Language Instructions to Mobile UI Action Sequences」では、一連の操作指示を自動で操作行動に変換するための最初のステップを示します。

ここでは、ディープラーニングモデルのトレーニングに使用できる3つの新しいデータセットを作成しています。このデータセットを使うと、自然言語による指示をモバイルユーザインタフェース上の操作アクションに変換する事を学習させる事ができます。

この研究は、ユーザインタフェースを細かく操作する必要性を軽減し、モバイルデバイス上のタスクを自動化するための技術的基礎を築きます。これは、視覚的または状況的に困難を抱えるユーザーにとって特に価値がある場合があります。

また、GitHubリポジトリを通じてモデルのコードとデータパイプラインをオープンソースとして公開し、研究コミュニティ間のさらなる発展を促進します。

自然言語の割り当てに関して基礎的な知識を持つモデルの構築

人々は、複雑な一連のアクションを伴うタスクを達成するために、共同で取り組みを調整し、互いに指示を出す事がよくあります。

例えば、誰かが書いたケーキを焼くレシピの指示に従う事や、または友人にホームネットワークのセットアップ方法を案内してもらう事などです。同様のヤリトリを支援できるエージェントを開発することは重要な目標です。しかし、これを実現するためには、各操作を何に割り当てるべきかを知る必要があり、そのために「操作が発生する環境内で使われている操作に関する真の知識」が必要となります。

今回学習するタスクは、「一連の指示」が与えられた時に「モバイルプラットフォーム上で実行すべき一連のアクション」が何かを予測することです。

「一連の指示」とは、「システムが1つの画面から別の画面に移行するときに生成される一連の画面」と、「それらの画面上の操作可能な要素」のセットです。

このようなモデルをエンドツーエンドでトレーニングするには、言語とアクションのペアのデータが必要になりますが、こういったペアデータを大規模に収集する事は困難です。

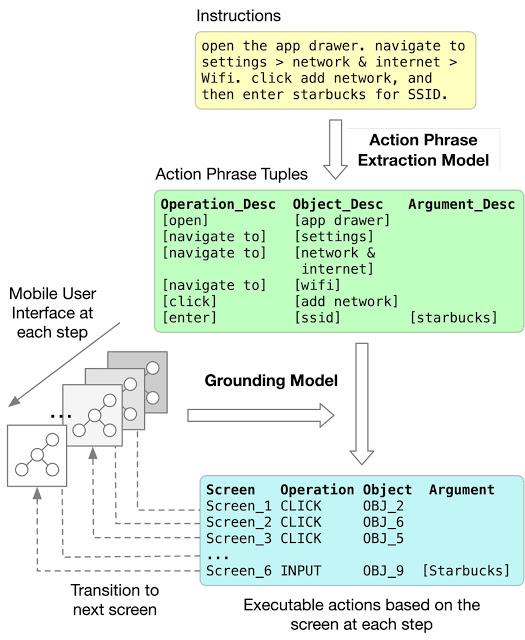

代わりに、問題を2つの連続するステップに分解します。アクションフレーズ抽出ステップと割り当て(grounding :グラウンディング)ステップです。

自然言語命令を実行可能なアクションに変換する作業の概要

3.Seq2act:機械学習でスマホ操作を人間の代わりに実行する(1/2)関連リンク

1)ai.googleblog.com

Grounding Natural Language Instructions to Mobile UI Actions

2)arxiv.org

Mapping Natural Language Instructions to Mobile UI Action Sequences

3)github.com

google-research/seq2act/

コメント