1.機械学習を利用して今現在の天気予報を行う(2/3)まとめ

・従来のオプティカルフローアルゴリズムは嵐の勢いが変化する事などは考慮出来ていない

・物理学から得られた大気の動きに関する知見は利用せず、画像予測問題として天気予報に挑戦

・画像問題で良く使われるCNNの一種であるU-Netをベースとしてモデルを開発して学習を行った

2.CNNを使った天気予報

以下、ai.googleblog.comより「Using Machine Learning to “Nowcast” Precipitation in High Resolution」の意訳です。元記事の投稿は2020年1月13日、Jason Hickeyさんによる投稿です。アイキャッチ画像のクレジットはPhoto by morais on Unsplash。

レーダー画像を時系列に並べて予測

私達のシステムが取り扱う事が可能な事例として、レーダー画像を時系列で並べた予測問題を考えてみましょう。過去1時間のレーダー画像の並びを与えられた場合、レーダー画像が今からN時間後にどうなるかを予測するのです。Nは0~6です。

レーダーによるデータは画像化されているため、これはコンピュータービジョンによる画像予測問題として扱う事が出来、入力画像の並びから画像の変化、つまり気象状態の進化を推測する事ができます。

短い時間間隔で考えると、気象状況の変化は2つの物理的要因に大きく影響を受けます。雲の動きによる温度の変化と、雲の形成による気流の変化です。どちらも地形と地理による影響を大きく受けます。

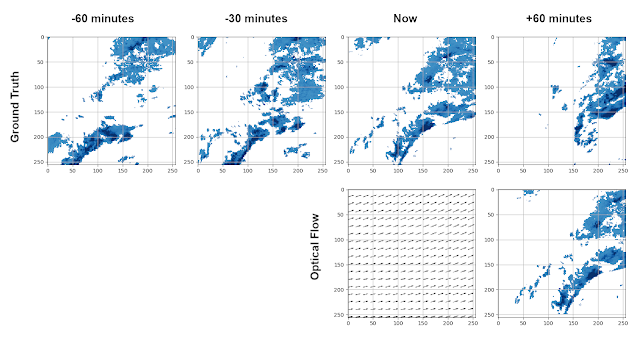

上段左から:最初の3つのパネルは、予測したい地点の60分、30分、0分前のレーダー画像を示しています。一番右のパネルは、60分後の本当のレーダー画像、つまり天気予報が100%合っていた時にはこれと同じ画像になります。

左下:上記の最初の3つのパネルのデータをモデル化するためにオプティカルフローアルゴリズムを適用して求めたベクトル場。オプティカルフローは、1940年代に開発されたコンピュータービジョン手法であり、短期的な天気の変化を予測するために良くに使用されます。

右下:オプティカルフローによる予測の実例。左下隅の降水地域帯の動きをよく追跡していますが、嵐の勢力が弱まる事を予測出来ていない事に注目してください。

物理学を用いた計算をしない、データ駆動型のアプローチを使用しました。つまり、ニューラルネットワークには、物理学から得られた大気が実際にどのように機能するかの知見を組み込むことをせず、トレーニング画像のみを使って大気物理学を近似する事を学習します。天気予報を「画像を画像に変換する問題」として扱い、画像解析の現在の最先端技術である畳み込みニューラルネットワーク(CNN)を活用します。

CNNは通常、連続したレイヤーで構成されます。各レイヤーは、入力画像を新しい出力画像に変換する一連の操作を行います。多くの場合、レイヤーは、畳み込みフィルターを使って画像を畳み込む(訳注:風呂敷を畳むように画像を畳み込むイメージです)ことに加えて、与えられた画像のチャンネル数と全体的な解像度を変更します。

これらのフィルター自体は小さな画像です。(今回のケースでは3×3または5×5の大きさです)フィルタはCNNの機能の多くを実現するための基礎となり、画像内の特徴的な検出、意味のあるパターンの識別などの操作をもたらします。

CNNの中でも特に効果的なネットワークがU-Netです。U-Netには、一連のレイヤーの中にエンコードフェーズとデコードフェーズが配置されています。

エンコードフェーズは画像の解像度を下げて低次元の特徴表現にします。次に、デコードフェーズではエンコードフェーズで行った低次元化を高解像度に戻します。

(訳注:画像を低解像度にギュッと圧縮する事でシンプルな画像を作り上げて、それをまたグッと広げる事により、画像の特徴に繋がる部分だけを強調させて、画像の特徴を抽出しようとしているイメージです)

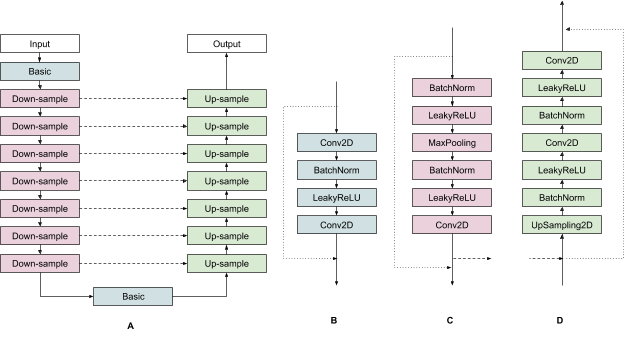

次の図は、私達が使用したU-Netの全てのレイヤーを示しています。

(A)U-NETの全体的な構造。青いボックスは、基本的なCNNレイヤーに対応しています。ピンク色のボックスは、ダウンサンプルレイヤーに対応しています。緑のボックスは、アップサンプルレイヤーに対応しています。実線は、レイヤー間の入力接続を示します。破線は、U-NETのエンコードおよびデコードフェーズを横断するロングスキップ接続を示します。点線は、個々のレイヤーの短いスキップ接続を示しています。(B)基本レイヤー内の詳細(C)ダウンサンプルレイヤー内の詳細(D)アップサンプルレイヤー内の詳細

U-Netへの入力は、マルチスペクトル衛星画像ごとに1つのチャネルを含む画像です。例えば、過去1時間に10個の衛星画像が収集され、それらのマルチスペクトル画像のそれぞれが10の異なる波長で撮影された場合、モデルへの画像入力は100チャンネルの画像になります。

レーダー間予測の場合、入力は過去1時間の30のレーダー観測値で、2分間隔で連続して与えられ、出力には現在からN時間後までの予測が含まれます。

米国での最初の実験では、2017年から2019年までの期間の米国本土での過去の観測からネットワークをトレーニングしました。データは4週間の期間に分割され、各期間の最初の3週間がトレーニングに使用され、4週間目のデータをモデルを評価するために使用しました。

3.機械学習を利用して今現在の天気予報を行う(2/3)関連リンク

1)ai.googleblog.com

Using Machine Learning to “Nowcast” Precipitation in High Resolution

2)arxiv.org

Machine Learning for Precipitation Nowcasting from Radar Images

コメント