1.MPNAS:写真も絵画も扱えるモデルを自動生成可能なニューラルアーキテクチャ探索(2/2)まとめ

・高度に関連したドメイン間ではネットワーク内のパスと構成要素の大部分が重複する

・MPNASから得られたモデルは従来モデルと比較して効率と性能で優位性があった

・元ネットワークをオンデバイス対応モデルにしたためモバイルフレンドリーにもなった

2.MPNASの性能

以下、ai.googleblog.comより「Building Efficient Multiple Visual Domain Models with Multi-path Neural Architecture Search」の意訳です。元記事の投稿は2022年8月3日、Qifei WangさんとFeng Yangさんによる投稿です。

アイキャッチ画像のクレジットはPhoto by Food Photographer phototastyfood on Unsplash

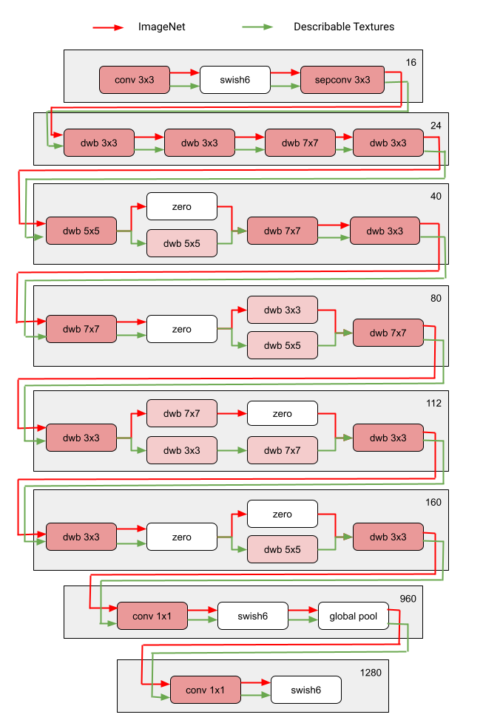

下の図は、Visual Domain Decathlonチャレンジに含まれる10のドメインのうち、2つの視覚ドメインについて、探索された設計を示したものです。これらの2つの高度に関連したドメイン(一方は赤、他方は緑)のサブネットワークは、重複するパスと構成要素の大部分を共有していますが、まだいくつかの違いがあることがわかります。

Visual Domain Decathlonチャレンジの10ドメインのうち、2つのドメイン(ImageNetとDescribable Textures)のアーキテクチャブロック

赤と緑のパスは、それぞれImageNetとDescribable Texturesのサブネットワークを表しています。濃いピンクのノードは、複数のドメインで共有されているブロックを表しています。薄いピンクのノードは、各パスが単独で使用するブロックを表しています。MobileNet V3風な探索空間に基づいてモデルを構築しています。図中の「dwb」ブロックは、dwbottleneckブロックを表します。図中の「zero」ブロックは、サブネットワークがそのブロックをスキップすることを表しています。

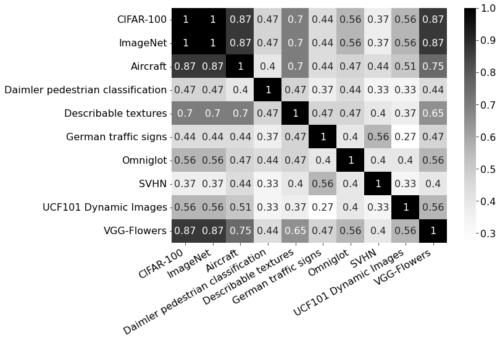

以下では、Visual Domain Decathlonチャレンジに存在する10のドメイン間のパスの類似性を示します。類似度は、各ドメインのサブネットワーク間のジャッカード類似度スコア(Jaccard similarity score)で測定され、高いほどパスがより類似していることを意味します。

予想通り、類似性の高いドメインほどMPNASが生成するパスのノードを多く共有しており、これは強いポジティブな知識転移の信号でもあります。

例えば、ImageNet、CIFAR-100、VGG Flowerのように自然画像中の物体を含む類似領域のパスは高いスコアを示し、Daimler Pedestrian Classification、UCF101 Dynamic Imagesのように歩行者が映っている白黒画像、様々な人間の活動を含む自然色画像などの非類似ドメインのパスは低いスコアとなっています。

10個のドメインのパス間のJaccard類似度スコアの行列。スコアの値は0から1までです。値が大きい程、2つのパスはより多くのノードを共有していることを示します。

不均一なマルチドメインモデルの学習

第2段階では、MPNASから得られたモデルを、すべてのドメインで一から学習させます。そのためには、すべてのドメインに対して統一的な目的関数を定義する必要があります。そこで、様々なドメインに対応できるように、学習プロセスにおいて、ドメイン間で損失がバランスするように適応するアルゴリズムを設計し、適応的バランスドメインプライオリティ(ABDP:Adaptive Balanced Domain Prioritization)と名づけました。

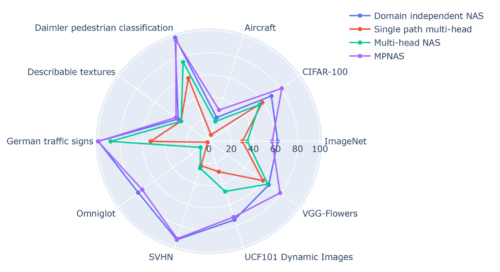

以下に、異なる設定で学習させたモデルの精度、モデルサイズ、FLOPSを示します。MPNASを他の3つのアプローチと比較します。

・ドメイン独立型NAS:各ドメインのモデルを個別に探索し、学習させます。

・シングルパスマルチヘッド。事前学習したモデルを全ドメインの共有バックボーンとして使用し、各ドメイン専用の分類ヘッドと分離します。

マルチヘッドNAS:ドメイン毎に分類ヘッドを分離し、全てのドメインに対して統一されたバックボーン・アーキテクチャを探索します。

この結果から、ドメイン独立型NASでは、ドメインごとにモデルを構築する必要があり、結果としてモデルサイズが大きくなることがわかります。シングルパスマルチヘッドNASとマルチヘッドNASは、モデルサイズとFLOPSを大幅に削減することができますが、ドメインを強制的に同じバックボーンを共有させるとネガティブな知識転移が発生し、全体の精度を低下させることがわかりました。

| Model | Number of parameters ratio | GFLOPS | Average Top-1 accuracy |

| Domain independent NAS | 5.7x | 1.08 | 69.9 |

| Single path multi-head | 1.0x | 0.09 | 35.2 |

| Multi-head NAS | 0.7x | 0.04 | 45.2 |

| MPNAS | 1.3x | 0.73 | 71.8 |

Visual DecathlonデータセットにおけるMDLモデルのパラメータ数、ギガFLOPS、Top-11精度(%)。全ての手法はMobileNetV3風な探索空間に基づいて構築されています。

MPNASは、全体として高い精度を維持しつつ、小さく効率的なモデルを構築することができます。MPNASの平均精度は、ポジティブな知識の転移が可能なモデルであるため、ドメインに依存しないNASアプローチよりもさらに1.9%高くなります。下図は、これらのアプローチのドメインごとのTop-1精度を比較したものです。

Visual Decathlonの各ドメインのTop-1精度

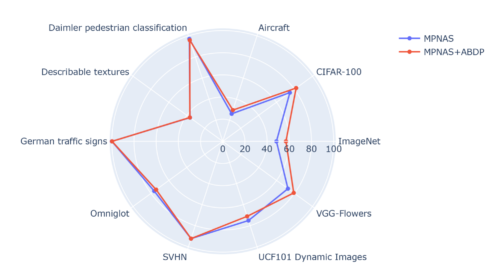

私達の評価では、ABDPを探索・学習段階の一部として用いることで、Top-1精度が69.96%から71.78%(デルタ:+1.81%)に向上することが示されました。

ABDPを使用した場合と使用しない場合のMPNASで学習したVisual Decathlonの各ドメインのTop-1精度

今後の課題

私達は、マルチパスニューラルアーキテクチャ探索(MPNAS:Multi-Path Neural Architecture Search)がマルチドメイン学習(MDL:Multi-Domain Learning)におけるデータの不均衡、ドメインの多様性、ネガティブな転移、ドメインの規模拡大、パラメータ共有可能な戦略を実現する大きな探索空間に対処するための不均一なネットワーク(heterogeneous network)を構築する効率的なソリューションであることを発見しました。

MobileNetのような探索空間を用いることで、結果として得られるモデルもモバイルフレンドリーなものとなっています。私達は、既存の探索アルゴリズムに適合しないタスクのマルチタスク学習のためにMPNASを拡張し続けており、他の人がMPNASを使って統一的なマルチドメインモデルを構築することを期待しています。

謝辞

この研究は、Googleの複数のチームの協力によって可能になりました。Junjie Ke, Joshua Greaves, Grace Chu, Ramin Mehran, Gabriel Bender, Xuhui Jia, Brendan Jou, Yukun Zhu, Luciano Sbaiz, Alec Go, Andrew Howard, Jeff Gilbert, Peyman Milanfar, そして Ming-Tsuan Yangの貢献に対し、謝辞を述べたいと思います。

3.MPNAS:写真も絵画も扱えるモデルを自動生成可能なニューラルアーキテクチャ探索(2/2)関連リンク

1)ai.googleblog.com

Building Efficient Multiple Visual Domain Models with Multi-path Neural Architecture Search

2)openaccess.thecvf.com

Multi-path Neural Networks for On-device Multi-domain Visual Classification(PDF)