1.CIW:ノイズの多いラベルを使ってディープニューラルネットを訓練する新手法(3/3)まとめ

・Mixupは元データセットから一対のサンプルを抽出して新しいサンプルを人工的に生成する手法

・MixupをCIW法を使ってクリーンなサンプルに重みを重視するように改良したのがCICW-Mixup

・CICW-Mixupは特にノイズ率が大きい場合に他と比較して大幅に性能が向上することが判明

2.CICW-Mixupとは?

以下、ai.googleblog.comより「Constrained Reweighting for Training Deep Neural Nets with Noisy Labels」の意訳です。元記事は2022年2月28日、Abhishek KumarさんとEhsan Amidさんによる投稿です。

アイキャッチ画像のクレジットはPhoto by Elyas Pasban on Unsplash

MixupとCICWの組み合わせ

また、得られたサンプルの重みを、モデルの正則化や予測性能の向上のためによく使われる手法であるMixup(混合)で利用する方法も提案します。

Mixupは、元のデータセットから一対のサンプルを抽出し、これらを凸結合させて新しいサンプルを人工的に生成することで動作します。モデルは、これらのMixupデータに対する損失を最小化するように学習します。

素のMixupは個々のサンプルの損失を気にしませんが、Mixupはクリーンなサンプルとノイズの多いサンプルを同等に扱うため、ノイズの多いデータでは問題が生じる可能性があります。CIW法で得られた高い重みを持つサンプルはきれいなサンプルである可能性が高いので、私たちはMixup用にサンプルを偏らせるために重みを使い、また(素のMixupのようなランダムな凸結合ではなく)重みを使って凸結合する事にしました。この結果、サンプルを混合(mixed-up)した新しいサンプルは綺麗なデータの方に偏ることになり、この手法をCICW-Mixupと呼ぶ事にします。

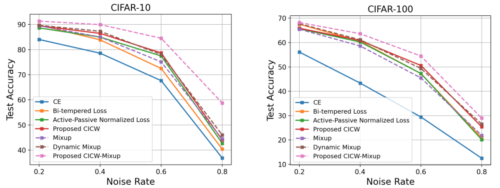

私達は、標準的なCIFAR-10およびCIFAR-100ベンチマークデータセットにおいてこれらの方法を試しました。合成ノイズの量を変えながら(各サンプルのラベルをランダムに他のラベルに付け替えながら)、すなわち、ノイズ率を0.2~0.8の間で変化させた対称的な合成ノイズを用いたクリーンデータでのテスト精度を以下に示しています。

私達の提案するCICWは複数の手法を凌駕し、mixupを使って学習用データセットセット全体で重要度を維持するdynamic mixupの結果と一致することが確認されました。また、今回提案する重要度重み付け手法とmixupを併用したCICW-Mでは、特にノイズ率が大きい場合に、他の手法と比較して大幅に性能が向上することがわかりました。(以下のグラフの右上に位置しています)

CIFAR-10とCIFAR-100の学習データに含まれる対称的な合成ノイズの量を変化させながら、クリーンなデータでのテスト精度を確認しました。比較した手法は、標準的なCross-Entropy Loss(CE)、Bi-tempered Loss、Active-Passive Normalized Loss、提案手法であるCICW、Mixup、Dynamic Mixup、提案手法であるCICW-Mixupです。

まとめと今後の方向性

私達は、ラベルノイズに対処するための新しい制約付き最適化問題を定式化し、サンプルとクラスラベルに再重み付けする際の簡単な数式を得ることができました。

また、これらの定式化は、ラベルノイズを含む学習に対する既存のラベルスムージングベースの手法に対する理論的な観点を提供します。更に、サンプルやクラスの再重み付けよりもさらに大きな性能向上をもたらす、mixupによるサンプル重みの利用法も提案しました。本手法はミニバッチレベルでのみ動作するため、最近のいくつかの他の手法のようにデータセットレベルで重みを維持する余分なオーバーヘッドを回避することができます。

今後の研究の方向性としては、大規模な実用環境で遭遇する現実的なノイズの多いラベルで本手法を評価したく思います。また、本フレームワークとラベルスムージングの相互作用を研究することは、ラベルスムージングの損失適応版となりうる興味深い方向性であると考えます。また、CICWのコードをGithubで公開できることを嬉しく思います。

謝辞

プロジェクトの過程で建設的なフィードバックを提供してくれたKevin Murphyに感謝します。

3.CIW:ノイズの多いラベルを使ってディープニューラルネットを訓練する新手法(3/3)関連リンク

1)ai.googleblog.com

Constrained Reweighting for Training Deep Neural Nets with Noisy Labels

2)arxiv.org

Constrained Instance and Class Reweighting for Robust Learning under Label Noise

3)github.com

google-research/ciw_label_noise/