1.Federated Analytics:データを一か所に収集せずにデータ分析を行う(2/2)まとめ

・Secure Aggregationにより、Federated Analyticsはより強力なプライバシー属性を実現できている

・このアプローチではより多くの人々のデータを集約するか、ランダムな値を追加することで更に強化可能

・「識別されにくいパターンは何か?」などの分散データに関する更に曖昧な質問に答える手法も開発中

2.Secure Aggregationとは?

以下、ai.googleblog.comより「Federated Analytics: Collaborative Data Science without Data Collection」の意訳です。元記事の投稿は2020年5月27日、Daniel RamageさんとStefano Mazzocchiさんによる投稿です。

アイキャッチ画像のクレジットはPhoto by Jack Young on Unsplash

Secure Aggregationを使ったFederated Analyticsの保護機構

Secure Aggregationにより、Federated Analyticsアプリケーションはより強力なプライバシー属性を実現できます。

Secure Aggregationを直感的に理解するために、楽曲の認識率測定問題のより単純なバージョンを検討してみましょう。

Rakshitaが友人のEmilyとZhengが特定の曲をどれくらい頻繁に聴いたかを知りたいとします。EmilyはそれをS_emily回、ZhengはS_zheng回聴いていますが、Rakshita、もしくはZhengと互いの聴いた回数を共有する事は居心地の良い事ではありません。

このケースでは三人は、代わりに、Secure aggregationを実行できます。EmilyとZhengは打ち合わせをして乱数Mを決定します。乱数MはRakshitaには秘密にします。EmilyはRakshitaに合計S_emily + Mを伝え、Zhengは差分S_zheng – Mを伝えます。

Rakshitaは(Mによって隠された)実質的にランダムな2つの数値を入手しますが、それらを合計すると

(S_emily + M) + (S_zheng – M) = S_emily + S_zhengとなり、二人が楽曲を聞いた合計回数を知る事ができます。

このアプローチではプライバシー属性は、より多くの人々のデータを集約するか、または小さなランダムな値を追加(例えば、差分プライバシーを用いる事により)することで更に強化できます。Now Playingの例では、何百ものデバイスから集めた結果を合計し、その後、楽曲の認識率がエンジニアに示されます。

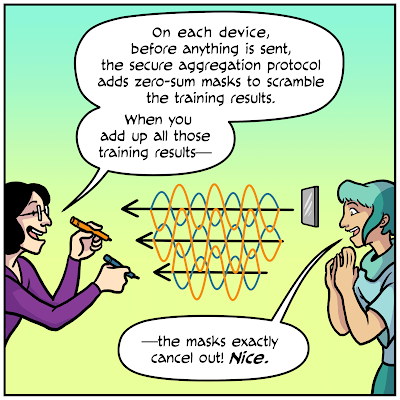

federated learningを解説したWeb漫画から抜粋したsecure aggregation protocolの解説場面

より優れたプライバシーを確保した機械学習とデータ分析に向けて

federated analyticsの手法は、活発な研究分野であり、すでに指標や件数の分析以上の事が出来ます。

場合によっては、federated learningを使ってMLモデルをトレーニングする事で、未加工の個人データをスマートフォンから収集する事なく、デバイス上のデータに関する総合的な洞察を得ることができます。

例えば、Gboardのエンジニアは、ユーザーが入力する一般的な新しい単語を見つけて、スペルチェックや入力候補選択時に使用する辞書に追加したいと考えていましたが、ユーザーが実際に入力した単語を直接見る事は出来ませんでした。

彼らは、スマートフォンで文字認識をするリカレントニューラルネットワークをトレーニングすることにより、これらのスマートフォンで入力された単語で、まだ辞書に収録されていないものを得る事が出来ました。

入力した単語はスマートフォンから送信される事はありませんでしたが、結果としてデータセンターで得られるモデルを使用して、頻繁に入力される文字の並び、つまり新しい単語を生成できたのです!

また、統合生成モデル(federated generative models)をトレーニングする事により、「データ内のどんなパターンが私のモデルで認識されにくいですか?」などの分散データセットに関する更に曖昧な質問に答える手法も開発しています。更に、ユーザーレベルの差分プライベートモデル(user-level differentially private model training)をトレーニングする事で、これらのモデルが特定のユーザーに固有の情報を含めないようにする方法を模索しています。

Googleのプライバシー原則に関するコミットメントは、最先端のユーザーデータ保護を推進することを意味します。このため、データセンターにおける差分プライバシーの推進やデータ収集時のプライバシー保護などを行っています。

Googleの最も初期の分散型データ分析システムであるRAPPORは2014年に導入されました。それ以来、大量のノイズ(多くの場合、差分プライバシーのために人工的に混入されます)入りデータであっても効果的な意思決定を行う事が出来る様に多くの研究を続けてきました。federated analyticsはこの一連の流れを継続するものです。

federated analyticsアプローチはまだ始まったばかりであり、多様なデータサイエンスの問い掛けに正確に答えるには、更なる進歩が必要です。

最近の論文「Advances and Open Problems in Federated Learning」では、federatedな手法に関する研究の包括的な調査を提供しています。その一方、論文「Federated Heavy Hitters Discovery with Differential Privacy」では、データセット内の最も頻出するアイテムを発見するためにfederated analytics手法を導入しています。

Federated analyticsにより、私達にデータサイエンスについて従来と異なった考え方をすることができます。

新しいデータサイエンスでは「分散型データ」と「プライバシー保護を確保したデータ集約」が中心的な役割を果たします。この分野での新たな貢献と拡張を歓迎します。

謝辞

この投稿は、以下を含む多くの人々の仕事を反映しています

Blaise Agüera y Arcas, Galen Andrew, Sean Augenstein, Françoise Beaufays, Kallista Bonawitz, Mingqing Chen, Hubert Eichner, Úlfar Erlingsson, Christian Frank, Anna Goralska, Marco Gruteser, Alex Ingerman, Vladimir Ivanov, Peter Kairouz, Chloé Kiddon, Ben Kreuter, Alison Lentz, Wei Li, Xu Liu, Antonio Marcedone, Rajiv Mathews, Brendan McMahan, Tom Ouyang, Sarvar Patel, Swaroop Ramaswamy, Aaron Segal, Karn Seth, Haicheng Sun, Timon Van Overveldt, Sergei Vassilvitskii, Scott Wegner, Yuanbo Zhang, Li Zhang, および Wennan Zhu。

3.Federated Analytics:データを一か所に収集せずにデータ分析を行う(2/2)関連リンク

1)ai.googleblog.com

Federated Analytics: Collaborative Data Science without Data Collection

2)arxiv.org

Now Playing: Continuous low-power music recognition

Towards Federated Learning at Scale: System Design

Advances and Open Problems in Federated Learning

Federated Heavy Hitters Discovery with Differential Privacy

3)federated.withgoogle.com

Federated Learning

コメント