1.ディープニューラルネットワークにおける一般化ギャップの予測(2/2)まとめ

・一般化ギャップと対数変換したマージン分布の統計的情報はほぼ完全に線形回帰式で表現可能

・マージン分布にモデルの一般化度合いに関する重要な情報が含まれている可能性が高い

・一般化を検証するためのデータセットであるDEMOGENも論文と共に公開されている

2.DEMOGENとは?

以下、ai.googleblog.comより「Predicting the Generalization Gap in Deep Neural Networks」の意訳です。元記事は2019年7月9日、Yiding Jiangさんによる投稿です。これも結果だけ読むと「なるほどなぁ」と気軽に感心してしまいますが、これほどまでに綺麗な相関を導き出すためにどれほどの試行錯誤を繰り返したんだろうと想うと「巨人の肩の上に立つ」の言葉を実感します。

私達は経験的にマージン分布と一般化の関係を研究しました。そして、距離を適切に正規化した後であれば、マージン分布のいくつかの基本的な統計値が一般化ギャップを正確に予測できることを示せました。Githubレポジトリで、一般化を研究するためのデータセットとして使用されるすべてのモデルも公開しています。

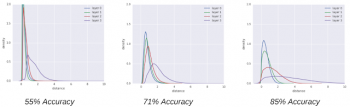

4層のネットワークにおける正規化マージン分布(x軸)と確率密度(y軸)。

各グラフは、CIFAR-10でトレーニングされた異なる分類精度を持つ畳み込みニューラルネットワークです。左のグラフから右のグラフにかけて、一般化の度合は向上していきます。正規化されたマージン分布は分類精度と強く相関しており、ニューラルネットワークの一般化ギャップを予測するために使用できる事を示唆しています。 これらのネットワークの詳細については、論文をご覧ください。

一般化を予測するためにマージン分布を使用

直感的に言えば、一般化性能がマージン分布の統計的情報を使って本当に予測できるのであれば、シンプルな方程式で両者の関係を整理できるはずです。

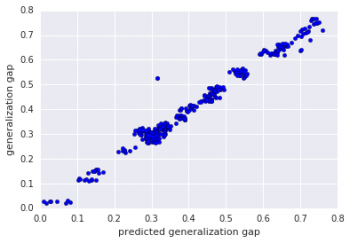

そのため、関係を整理するために線形回帰式を使用する事にしました。その結果、私達は、一般化ギャップと対数変換したマージン分布の統計的情報は、ほぼ完全に線形回帰式として表現できる事を発見しました(下図)。

事実、今回提案した予測手法は、他の既存の一般化尺度計測手法と比較して、より良い予測が出来ています。これは、マージン分布にモデルの一般化度合いに関する重要な情報が含まれている可能性がある事を示唆しています。

CIFAR-100 + ResNet-32における一般化ギャップの予測値(x軸)と真の一般化ギャップ(y軸)の図。ほぼ全ての点は対角線の近くにあります。これは、対数線形モデルの予測値が真の一般化ギャップに非常によく一致している事を示しています。

DEMOGEN:ディープモデルの一般化を検証するデータセット

論文に加えて、私達はディープモデル一般化データセット(DEMOGEN)を公開しています。DEMOGENには、CIFAR-10およびCIFAR-100データセットでトレーニング済みの756びディープモデルと各モデルの検証パフォーマンスから構成されています。

モデルは、CNNs(Network-in-Networkに似た構造です)およびResNet-32の変種であり、一般的な正則化手法とハイパーパラメーターの設定とは異なり、広い範囲の一般化挙動を確認できるように設定されています。例えば、CIFAR-10で訓練されたCNNsモデルは、テスト精度は60%から90.5%の範囲で、一般化ギャップは1%から35%の範囲となっています。

データセットの詳細については、私たちの論文またはGithubリポジトリをご覧ください。データセットのリリースには、私達のモデルを簡単にロードし、論文に掲載された結果を再現するためのユーティリティも含まれます。

DEMOGENデータセットを使えば、多数のモデルを再トレーニングする必要がなくなります。この研究とDEMOGENデータセットが、コミュニティにとって、ディープラーニングで一般化を研究する際に利用可能なツールとして助けになる事を願っています。また、私達の研究結果が一般化ギャップの予測因子と隠れ層のマージン分布の関係に関するさらなる研究の動機となる事を願っています。

3.ディープニューラルネットワークにおける一般化ギャップの予測(2/2)関連リンク

1)ai.googleblog.com

Predicting the Generalization Gap in Deep Neural Networks

2)arxiv.org

Understanding deep learning requires rethinking generalization

3)openreview.net

Predicting the Generalization Gap in Deep Networks with Margin Distributions

4)github.com

google-research/demogen/