1.ディープラーニングで科学分野の画像解析を手助けする試みまとめ

・科学の世界でも膨大な画像データの処理にディープラーニングが期待されている

・今回、画像のフォーカスが合っているか否かを判断する学習済みモデルが公開された

・FijiとCellProfilerのプラグインとして利用できる

2.画像のフォーカスレベルをディープラーニングで判断する試み

科学分野で使われている機器の多く、特にマイクロスコープは毎日数テラバイト(1テラバイトは1,024ギガバイト)のデータを作り出す。これらの画像は量があまりに多すぎて従来は有効活用が難しかったが、昨今のディープラーニングと画像解析技術の向上で有効利用ができるようになってきた。沢山の科学者達がプログラムを自身で書く事はできなくても、ディープラーニングを使って画像から有意義な事を読み取れないか期待をしている事もわかってきた。

今回、Googleが特に挑戦した事は、沢山の写真からフォーカスが合っていない写真を選び出す事だった。最新のオートフォーカス機能搭載のマイクロスコープであっても、設定が間違っていたりハードウェアが適切でないと画像の品質に問題が発生する。フォーカスレシオ、すなわち個々の写真のフォーカスがどの程度合っているかが自動的に検出できれば、品質の低い写真を自動的に特定したり削除する事ができる。

Googleはディープラーニングを使い、マイクロスコープで撮った写真のフォーカスレシオを以前の手法より正確に検出できるようにした。そしてフォーカスレシオ予測のTensorFlowモデルを、科学分野の画像解析ツールとして有名なFijiとCellProfilerのプラグインとして簡単に利用できるようにした。

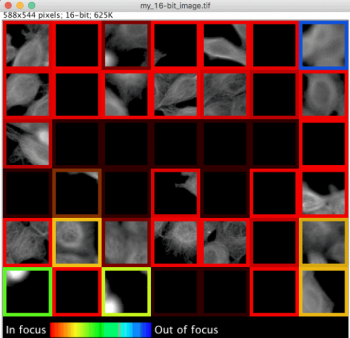

赤色がフォーカスが合っている写真、青色に近づくほどフォーカスがずれた写真

以前のフォーカス診断ツールはユーザがどこまでのピンボケを許すか閾値を決定する必要があったが、今回開発したツールは設定不要で全てを自動的に判断し、フォーカスレシオを枠の色でユーザに示す。今回のツールでGoogleが挑戦した興味深い事は、何も映っていないブランク写真もブランクと言う別カテゴリに分けるのではなく、ブランクであってもフォーカスレシオを予測できるようにモデルを構成した。

ブランクをブランクとして除外していない理由がイマイチわからなかったのですが、サンプル画像を見ると確かに真っ黒い画像であっても赤枠でフォーカスが合ってると見なされているケースがあります。ブランクも含めてフォーカスレシオの分布がわかれば、そもそも何かの不具合でピンボケ写真が多くなってしまっているのか否かがわかると言う事でしょうか。それとも学習用データをラベリングやカテゴリ分けせずに学習させる事に成功したと言う事でしょうか。後者ですかね。

3.ディープラーニングで科学分野の画像解析を手助けする試み関連リンク

1)research.googleblog.com

Using Deep Learning to Facilitate Scientific Image Analysis

2)kaggle.com

2018 Data Science Bowl