1.控えめな天才:GoogleのAutoMLの背後にいる人まとめ

・seq2seq、doc2vec、AutoMLを開発したGooleの研究者、Quoc Leの経歴紹介

・猫認識ディープラーニングから直近は機械学習を使用した機械学習の自動化に注力している

・AutoMLを使ってヌードル画像に基づいて95%の精度でレストランを識別するモデルを構築した人もいる

2.Quoc Le、AutoMLの作成者

以下、medium.comよりAn Unassuming Genius: the Man behind Google’s AutoMLの意訳です。

スリムで、もの静かで、厚手のメガネを着用しているQuoc Leは、AI分野で革命を起こしている人物としてあなたにインパクトを与えません。

2011年、Leは彼の博士号のアドバイザーであるAndrew Ng、GoogleフェローのJeff Dean、GoogleリサーチャーのGreg CorradoとGoogle Brainを共同設立しました。目標は、Googleの巨大なデータの中でディープラーニングの可能性を模索することでした。それ以前は、Leはスタンフォード大学で教師なしディープラーニングについていくつかの先進的研究を行っていました。

2012年、Leは、ディープラーニングが世間の大きな注目を集めるきっかけとなる論文(ICMLで発表されました)を発表しました。彼は、Youtubeの1000万のデジタル画像と、ImageNetデータセットの3000以上のオブジェクトに基づいて猫を認識できるディープニューラルネットワークモデルを開発したのです。

その巨大なシステムは16,000台のマシンと1億のシナプスで構成され、これまでの同様な試みの100倍の大きさでした。 その年の後半、Leの論文にAlexNetの論文が続き、ディープラーニングの分野全体の牽引を開始しました。

教師なし学習のアプローチは、商用では実用的ではないことが実証されましたが、― 少なくともその期間中は ―、Leは2015年のWiredのインタビューで次のように述べています:「教師なし学習の有用なアルゴリズムが発見できれば素晴らしい事です。実際には、ラベル付きデータよりもはるかにラベルのないデータが多いためです。」

Sequence to Sequence Learning

2013年に卒業してリサーチサイエンティストとしてGoogleに正式に参加したLeは、機械学習コミュニティの中で最も活発な研究分野の1つである機械翻訳で画期的な成功を達成しました。

この結果を達成するために、ディープラーニングの限界を超えなければなりませんでした。自然言語は文の長さが異なりますし、単語の順序が重要です。画像もサイズは一定ではありません。しかし、当時のディープラーニングは固定長の入力しか上手に扱う事ができなかったのです。

2014年、LeはIlya SutskeverとOriol Vinyalsと共に sequence to sequence learning (seq2seq)を提案しました。

これは、ある分野から別の分野にシーケンスを変換するモデル(例えば、異なる言語間の文など)を訓練する汎用のエンコーダ/デコーダフレームワークです。

seq2seqの学習では、エンジニアリング設計の選択肢が少なくて済み、Google翻訳システムは非常に大規模なデータセットに対して効率的かつ正確に作業できます。主に機械翻訳システムに使用されており、テキスト要約、会話型AI、質問回答などの幅広いタスクに適用可能であることが証明されています。

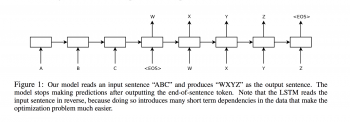

私達のモデルはセンテンス「ABC」を読み込むと「WXYZ」をセンテンスとして出力します。モデルは文末を意味する印を発見すると予測の出力を停止します。LTSMが入力センテンスを逆に読み込む事に留意してください。それによりデータに多数の短距離依存関係を導入し、最適化問題の解決をやりやすくします。

Leはさらにdoc2vecを発明しました。教師無しアルゴリズムは、文章、段落、文書などの可変長のテキストから固定長の特徴表現を学習します。 doc2vecはword2vecの拡張版で、Googleの同僚であるTomas Mikolovによって2013年に発表されました。そのアイデアは、各単語をベクトルで表すことで、それにより、収集した文章を用いて自動で学習することができます。 Leは段落ベクトルを追加したので、モデルはその長さにかかわらず文書の表現を生成することができます。

Googleは、2016年にAIを使用してより良い翻訳を作成するために時間をかけて学習するNeural Machine Translationシステムを発表し、Leの研究努力が実を結びました。

2015年、LeはMIT Technology Reviewのヴィジョナリーカテゴリの「35歳未満の発明家」リストを作り「ソフトウェアをもっとスマートにし、日常生活の中で人々を手助けし、幸せにする」ことを目標としました。

AutoML: ニューラルネットワークが自らを改善する

ディープニューラルネットワークをトレーニングするには、大量のラベル付きデータと前後の実験が必要です。アーキテクチャーを選択し、隠れたレイヤーを構築し、出力に基づいて重みを調整します。機械学習のエキスパート以外の人にとっては、トレーニングプロセスは何とかやっかいで時間がかかる事です。

2016年、Leともう一人のGoogleの同僚のBarret Zophは、neural architecture searchを提案しました。

彼らは、RNNを使用して、ニューラルネットワークのモデル記述を生成し、このRNNを強化学習で学習させて、検証セット上で生成されたアーキテクチャの予想精度が最大になるようにしました。

この新しいアプローチは、研究者がCIFA-10データセットのテストセットの精度において人間のエキスパートが作成した最高のニューラルネットワークアーキテクチャに匹敵しうる斬新なネットワークアーキテクチャを設計するのに役立ちました。1年後、LeとZophは、大規模な画像データセットの転送可能なアーキテクチャーであるNASNet-Aを提案することによって、次のレベルへの研究を行いました。

左:人間の機械学習エキスパートによって作成されたニューラルネットワーク

右:AutoMLを用いて自動的に作成されたニューラルネットワーク

Leの研究は、機械学習の専門知識とリソースを持たない開発者向けに設計されたGoogle製品群の一つであるAutoMLの基礎を築いています。

まだ研究の初期段階ですがAutoMLは現実の問題を解決しています。データサイエンティストは、AutoMLを使ってヌードル画像に基づいて95%の精度でレストランを識別するモデルを構築しました。日本の開発者は、AutoMLを使って画像からブランド名を分類できるモデルを構築しました。

Googleは今年初めにAutoML Visionを開始しました。先月GoogleのCloud Nextカンファレンスで、同社は翻訳と自然言語に関するツールもリリースしています。過去6年間、Leはディープラーニング開発の最前線にとどまっています。 36歳のGoogleの研究者は今、次のレベルに深く学ぶ姿勢を示しています。マシンは最終的にデータサイエンティストを置き換えるでしょうか?これは答えを待つ質問です。

11月9日にカリフォルニア州サンノゼで開催されるAI Frontiers Conferenceで、Leは「Using machine learning to automate machine learning(機械学習を使用した機械学習の自動化)」のテーマで講演をし、特にNeural Architecture SearchとAutoAugmentについて話をする予定です。

3.控えめな天才:GoogleのAutoMLの背後にいる人感想

AutoMLが解決している現実世界の問題、すなわち「AutoMLを使ってヌードル画像に基づいて95%の精度でレストランを識別するモデルを構築しました」の部分、わざと直訳したのですが、はい、間違いなく世界に羽ばたくジロリアン人工知能ですね。思わぬところで出てきて噴き出してしまいました。

4.控えめな天才:GoogleのAutoMLの背後にいる人関連リンク

1)medium.com

An Unassuming Genius: the Man behind Google’s AutoML