1.人工知能の誤動作を目的とした敵対的データと戦うコンペまとめ

・人工知能の誤動作を目的とした敵対的データに対抗するコンペが開催

・コンペは防衛側と攻撃側とに分かれて鳥と自転車を間違わない事を競い合う

・コンペは事前準備期間と本期間に分かれており、事前準備期間用のデータは既に公開されている

2.人工知能に対する敵対的データの攻撃とは?

以下、ai.googleblog.comより「Introducing the Unrestricted Adversarial Examples Challenge」の意訳です。

機械学習は医療、科学、農業など現実世界の様々な分野で益々使われるようになっています。しかし、機械学習をミスが許されないミッションクリティカルな業務に使用するにはクリアしなければならない重大な課題が残っています。機械学習は細工をされた敵対的なデータに対して非常に脆弱なのです。攻撃者は、データの中に機械学習モデルが誤動作するような細工を潜ませて敵対的データとして送り込んできます。

敵対的データに関する従来のほとんどの研究は、人工知能が「小さな変更」で誤動作してしまう事を改善する事に集中していましたが、実世界の敵対的工作員はそのような「小さな変更」の制約を受けません。

更に、機械学習アルゴリズムは、敵対的データに直面した時、しばしば確信をもってとんでもない間違いをする可能性があり、そのように確信をもって誤判断をする事は防がなければなりません。特に機械学習システムを欺くために任意の入力を色々と試す事ができる敵対的な存在がいる状況下では、解決せねばならない重要な問題です。

本日、私達は「Unrestricted Adversarial Examples Challenge」を開催します。機械学習モデルが確信を持って分類を間違う事をなくすため、インセンティブを与えて技術の進捗状況を測定するコミュニティベースのコンペです。

以前の研究は、事前にラベル付けされたデータに「わずかな変更」(研究者が小さな細工の後に細工前と同じラベルに分類できると仮定できるようにする)に限定された敵対的な例に焦点を当ててきましたが、今回の挑戦は無制限の細工を可能にし、より多くの種類の敵対的なデータに対抗し得るモデルを開発し、テストすることができます。

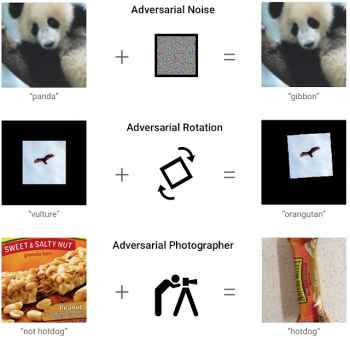

敵対的なデータの例は、入力ピクセルを少し変更するだけでなく、誤った分類入力を見つけるために空間変換や簡単な試行錯誤を使用してさまざまな手段で生成することができます。上:「パンダの画像にノイズを加えてテナガザルの画像と誤認識させる」中:「禿鷹の画像を回転させてオランウータンの画像と誤認識させる」下「お菓子の画像の写真の撮り方を工夫してホットドッグと誤認識させる」

チャレンジの詳細

参加者は、防御側として参加し偽造に対する防御を高めた人工知能を提出することができます。もしくは、攻撃側として参加し防御側の人工知能を欺くために任意の敵対的データを提出することによって参加する事もできます。

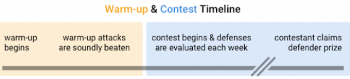

チャレンジ開始前の「ウォーミングアップ」期間に、私たちは一連の敵対的データによる攻撃パターンを提示します。参加者はその攻撃を防御できるようなネットワークを設計する事ができ、コミュニティが事前に与えた固定攻撃を完全に防御できるようになったら、私達は攻撃側と防御側に分かれた賞金付きコンテストを正式に開始します。

このチャレンジのために、私達は「鳥か自転車か?」を判別する簡単な分類タスクを作成しました。人工知能はシンプルな問いに答えなければなりません「以下の写真は下記のいずれですか?」

・明確に鳥

・明確に自転車

・鳥か自転車かどちらなのか曖昧

・明確に鳥でも自転車でもない

私たち人間にとっては鳥と自転車を区別することは非常に簡単なのでこの課題を選択しましたが、敵対者が存在する世界では、すべての既知の機械学習技術はこの課題に苦しんでいます。

防御側の人工知能の目標は、鳥や自転車のクリーンなテストデータを高精度で正確にラベル付けを行いつつ、攻撃側が提供する敵対的データに対して「確信を持って間違う」事を防ぐことです。攻撃側の目標は、防御側の人工知能が確信を持って自転車を鳥に、もしくは鳥を自転車に間違うような画像を見つける事です。

このチャレンジをできるだけ防御側に有利にしたいので、曖昧な画像(鳥が自転車に乗っているような画像)や明確に鳥でも自転車でもないもの(空中から見た公園の写真やランダムノイズなど)は捨てます。

曖昧な画像と曖昧でない画像の例。防御側人工知能は曖昧でない鳥や自転車の画像を自信を持って間違ってはいけません。私たちは、人間の目で見て曖昧または明白でないと判断した全ての画像を破棄します。 すべてのイメージはCCライセンスの下にあります。左上「明確に鳥」右上「明確に自転車」左下「鳥か自転車か曖昧」右下「明確に鳥でも自転車でもない」

攻撃側は、防御側人工知能を欺くために、どんな手段を使ってもOKです。例えば、攻撃者は鳥の写真を撮る事も良いですし、3Dレンダリングソフトウェアを使用したり、画像編集ソフトウェアを使用して画像合成を行う事、人工知能を用いて新規に鳥画像を生成してもOKです。

攻撃側が提供する新しい画像を検証するため、複数の人間が画像に対してラベル付けします。この手順により、攻撃側は小規模に修正されたテストセット画像だけでなく、任意の画像を送信できるようになります。防衛側分類器が、人間が満場一致で自転車としてラベル付けした攻撃者提供の画像を「鳥」として自信をもって分類したら、防御側の人工知能の負けです。貴方は私たちの論文で、今回のチャレンジの詳細をもっと詳しく知ることができます。

参加するには?

参加に興味があるならgithubのプロジェクトで参加のためのガイドラインを見つけることができます。ウォームアップのためのデータセット、評価パイプライン、ベースライン攻撃を既に公開しており、最新の防衛側ランキングを更新していきます。あなたのエントリーを楽しみにしています!

謝辞

Unlimited Adversarial Examples Challengeのチームには、GoogleのTom Brown、Catherine Olsson、Nicholas Carlini、Chiyuan Zhang、Ian Goodfellow、OpenAIのPaul Christianoが含まれます。

3.人工知能の誤動作を目的とした敵対的データと戦うコンペ関連リンク

1)ai.googleblog.com

Introducing the Unrestricted Adversarial Examples Challenge

2)github.com

unrestricted-adversarial-examples

3)drive.google.com

Unrestricted Adversarial Examples

コメント