1.目を正面から撮影した写真で病気の兆候を検出(2/3)まとめ

・モデルの性能をAUCで測定したところ、HbA1c の上昇を 67 ~ 70% で測定できた

・リストの上位5%を見ると69%はHbA1c測定値が9以上でこれは有意に高かった

・アルゴリズムは画像の中心部、目の強膜、虹彩、瞳孔の領域などから最も影響を受けていた

2.モデルは眼のどこに注目しているのか?

以下、ai.googleblog.comより「Detecting Signs of Disease from External Images of the Eye」の意訳です。元記事は2024年3月24日、Boris BabenkoさんとNaama Hammelさんによる投稿です。

アイキャッチ画像のクレジットはPhoto by Debashis RC Biswas on Unsplash

モデルの性能は、陰性患者よりも陽性患者に高いスコアを与える頻度を定量化したAUC(Area under the receiver operator characteristic curve)を用いて測定しました。(すなわち、ランダムな推測では 50%になり、完全なモデルでは 100%になる値です)

このモデルは、さまざまなタイプの糖尿病性網膜疾患を 71 ~ 82%のAUC で検出し、HbA1c の上昇を 67 ~ 70% の AUC で、脂質の上昇を 57 ~ 68% の AUC で検出しました。これらの結果は、不完全ではありますが、外眼部の写真は、全身の健康状態の様々なパラメータの検出と定量化に役立つことを示しています。

CDCが使っている糖尿病スクリーニング質問票のように、眼底写真は人々の「事前スクリーニング」に役立ち、さらなる確認検査が必要な人々を特定できるかもしれません。私たちの研究に参加したすべての患者を予測されるリスクに基づいて分類し、そのリストの上位5%を見ると、そのうちの69%はHbA1c測定値(糖尿病患者の血糖コントロール不良を示すもの)が9以上でした。

ちなみに、人口統計と糖尿病罹患年数に基づくリスクスコアで最もリスクの高い患者さんでも、HbA1c≧9は55%にすぎず、無作為に選ばれた患者さんではHbA1c≧9は33%にすぎませんでした。

潜在的なバイアスの評価

この研究は、有望ではありますが、まだ初期の、新しい発見を示す概念実証の研究であることを強調しておきます。とはいえ、データやモデルに潜在するバイアスを評価することは重要であると考え、バイアスの評価には多方面からアプローチしました。

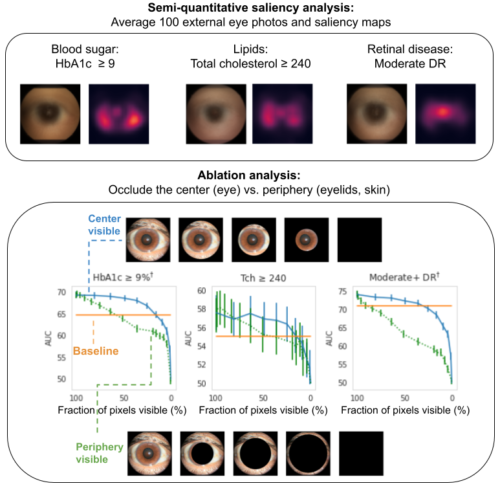

まず、(貧血の研究と同様に)画像のどの部分がアルゴリズムの予測に最も寄与しているかを明らかにすることを目的として、様々な説明可能性に関する分析を行いました。

顕著性分析(どのピクセルが予測に最も影響を与えるかを調べる)とアブレーション実験(様々な画像領域を削除した場合に出る影響を調べる)の両面から、アルゴリズムは画像の中心部(目の強膜、虹彩、瞳孔の領域で、まぶたは含まない)に最も影響を受けることが示されました。

これは以下のように示されます。画像を見えなくする箇所を中心部(緑の線)から始めた場合に、周辺部(青の線)から始めた場合よりもはるかに早くAUCが減少していることがわかります。

説明可能性分析によると、(上)はすべての予測が目の異なる部分に焦点を当てており、(下)は画像の中心(眼球の一部に相当)を塞ぐと、周辺(まぶたなどの周囲の構造に相当)を塞ぐよりもはるかに大きな効果があり、緑の線がより急な減少を示していることがわかります。比較対象モデルは、自己申告による年齢、性別、人種、糖尿病罹患年数を入力とするロジスティック回帰モデルです。

3.目を正面から撮影した写真で病気の兆候を検出(2/3)関連リンク

1)ai.googleblog.com

Detecting Signs of Disease from External Images of the Eye

2)www.nature.com

Detection of signs of disease in external photographs of the eyes via deep learning(PDF)