1.Google Pixel 3が突破したデジタルカメラの5つの限界(2/2)まとめ

・Synthetic Fill Flash:写真から人物のみを切出して光を当てる合成フラッシュ

・Learning-based Portrait Mode:従来より被写体を目立たせるポートレートモード

・Night Sight:夜間でも非常に明るい写真が撮影できる夜間撮影モード

2.Pixel 3が最終的に目指した事

以下、www.dpreview.comより「5 ways Google Pixel 3 camera pushes the boundaries of computational photography」、Pixel 3のカメラのレビューの意訳です。GoogleのAIのTOPのJeff Deanが良い記事だとTwitterで言っていた記事の後半です。前半はこちら。Pixel 3関連の記事のまとめはこちら

Google Pixel 3のカメラの5つの新機能、

(1)Super Res Zoom(超解像度ズーム)

(2)Computational Raw(計算された生データ)

(3)Synthetic Fill Flash(合成フィルフラッシュ/合成日中シンクロ)

(4)Learning-based Portrait Mode(機械学習によるポートレートモード)

(5)Night Sight(夜間撮影モード)

の(3)~(5)の解説です。

Pixel 3のSynthetic Fill Flash(合成フィルフラッシュ/合成日中シンクロ)

「Synthetic Fill Flash」は、反射板が配置されているかのように、人物のみに輝きを与えます。

写真家は、しばしばリフレクター(反射板)を使用して、背後から光があたっている被写体の顔を照らし、被写体が影にならないようにします。Pxcel 3はこれと同様な効果を計算によって実現できます。Pixel 2のカメラがポートレートモードで使用している「機械学習に基づく切り出しアルゴリズム」と同様な手法を用いて、写真から人物を識別して切り出し、暖かい光を人物のみに加える事ができます。

Pixel 2で前面カメラを使ってポートレイトモードで撮影すると、Pixel 2が非常に上手に人物を検出し、人物だけを切り抜いている事に気づいたと思います。Pixel 3は、合成フィルフラッシュで同じ切出し手法を使用することで、フレーム内から人間のみを切り出して光を当てる事ができます。フレーム内の他の物体を人間と間違えたり光を当てることはほぼありません。

興味深いことに、人物を特定するのに使用されている同じ切り出し方法は、フロントカメラを用いて撮影したビデオ画像から手ブレを除去する安定化にも使用されており、これはvloggers(主に動画をコンテンツとしたブログを書いている人)にとって大きなニュースです。

あなたがvloggingしている場合、通常、あなたは背景ではなく自分自身が動画の中でブレずに安定して写ることを望むでしょう。しかし、これは典型的なジャイロベースの光学式手ブレ補正では不可能です。Pixel 3は動画内の各フレームを分析し、デジタルスタビライザーを使用してフレーム内で人物を固定します。このモードを有効にすると少し画像が小さくなってしまう不便な点もありますが、この機能は自分自身でカメラを持って撮影している人が非常に安定してビデオに映る事を可能にします。

Pixel 3のLearning-based Portrait Mode(機械学習によるポートレートモード)

Pixel 2は、レンズが1つしかないにも関わらず、私達がテストした中でベストな性能を持つポートレートモードを実現していました。

これは、レンズの機能ではなく、その背後にある画像を画素単位に分割して効果的に用いる手法と、写真内の人間と非人間を画素単位で区別する人工知能の組み合わせによるものです。さらに、デュアルピクセルAFは、光があまり当たっていない動きの遅い被写体に対しても堅牢なパフォーマンスを実現します。これは絶え間なく動く幼児を撮影するのに最適です。Pixel 3は、同様にカメラが一台しかないにもかかわらず、いくつかの重要な改善をもたらしました。

Marc Levoy氏は次のように述べています。「従来はデュアルピクセルから計算をして機能を実現していましたが、現在は、機械学習を行っています。現在もデュアルピクセルを使用していますが、従来のアルゴリズムではありません。」

これが意味する事は、結果が改善されたと言うことです。背景をより均一にぼやかす事が出来、深度マップのエラーも少なくなりました。

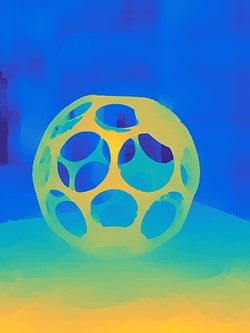

他の多くの手法では、上手く扱う事ができない複雑な事例を見てみましょう。前面の物体の穴を通して見える遠くの背景を均一的にぼやかす事が出来る事例は下記です。

訳注)他のスマートフォンは複数のカメラを用いてステレオ撮影、つまり被写体を複数の異なる方向から同時に撮影することにより、その奥行き方向の情報も記録できるようにしています。Pixel 3はリアカメラは一つしかありませんが、機械学習を用いて、単純なステレオカメラを超える性能を実現しています。

Pixel 3の機械学習ベースの写真

背景オブジェクト、特におもちゃの穴を通して見れるものは、一貫してぼやけています。おもちゃの周囲の物体も、より一貫してぼやけています。

Pixel 3の機械学習ベースの深度マップ

背景(青色)のオブジェクトが、前面(黄色)に近いものとして混同されていない事に注目してください。

従来のステレオカメラによる手法

背景オブジェクト、特におもちゃの穴から覗ける風景のボヤケは一貫していません。

従来のステレオカメラによる深度マップ

バックグラウンドのいくつかの要素が、実際よりも前景に見えることに注目してください。

興味深いことに、この機械学習ベースの手法は、人が遠くにいる中距離撮影でもより良い結果を生み出します。通常は、被写体が遠くなればなるほど、被写体と背景の立体視差が小さくなり、正確な深度マップの計算が難しくなります。以下のポートレートモードの比較を見てみましょう。上が機械学習ベースの新しい手法で下が従来手法です。

機械学習ベースの手法

背景が均一にデフォーカスされ、地面は滑らかで緩やかにデフォーカスされています。

ステレオカメラのみの結果

背景の石段がデフォーカスされておらず、地面も焦点の境目で急激に変化している事に注目してください。

Pixel 3のNight Sight(夜間撮影モード)

Night Sightは、低照度の露出を長時間行うのではなく、非常に暗い状況でも写真を撮影可能にするためにHDR +バーストモード撮影を利用しています。

以前のPixel 2はシャッタースピードを1/15秒以下に遅くすることはありませんでした。ゼロシャッターラグ(連続撮影時はシャッターを押す前から撮影が始まっているのでシャッターを押す事が遅れても押す前の風景が既に取られているためシャッターチャンスを逃さない機能)を実現する9フレームバッファーを維持するためにシャッタースピードを速くする必要があったからです。つまり、Pixel 2でも、非常に暗い場面では0.6秒(9 x 1 / 15s)のフレームを効果的に使用して明るさを補完する事ができるのですが、これでは極端に暗い場面では満足のいく品質の写真が得られないことがあります。

Pixel 3のカメラは最大15フレームを融合します。それは5秒間の露出に相当する画像を取得する事と同等です。

Pixel 3には夜間撮影に適したNight Sightモードがあります。Night Sightモードでは、ゼロシャッターラグは使えなくなり、シャッターボタンを押した後にカメラをしっかりと保持することが必要になります。しかし、そうすることで、カメラは最大15フレーム(個々のシャッター速度は1/3秒)が融合され、5秒間の露出に相当する画像が得られます。しかし、Night Sightモードでは必然的にそのような長い露出から生じるはずであるモーションブラー(被写体のブレ)を発生させません。

簡単に言えば、15枚連続撮影時の5秒間には被写体や手ブレが発生する可能性が高いです。しかし、15枚のそれぞれは1/3秒で瞬間的に撮影したスナップショットなため、おそらく多少は位置関係が変化しているものの、依然としてそのほとんどがシャープな画像である可能性が高いです。

そして、Googleの「堅牢な融合」技術、つまり写真を複数のタイルに分割し、分割したタイルに対応する他のフレームのタイルがどれかわかるように整列させてから、各タイルの画素情報融合させる手法では、被写体の動きによりボヤケが大きくなっているタイルは破棄するので、フレーム間で動いている被写体も処理できます。

以下の結果を見てください。これはまた、より広い撮影角度が可能なgroupieフロントカメラの利点を示しています。

通常のフロントカメラを使った自撮り

Night Sightモード

第二フロントレンズgroupieを使用した広角撮影

さらに、Night Sightモードでは、自動的にホワイトバランスを決定する機械学習ベースの手法が用いられています。このような暗い環境で非常に明るい光源バランスをセッティングすることは、しばしば非常に困難であるためGoogleは人工知能によるAWBを使用して自然に見える画像を生成することにしたのです。

Pixel 3が最終的に目指したもの:シンプルに楽しめる写真

Pixelカメラの背後にある哲学と、今日の多くのスマートフォンカメラの背後にある哲学は、ワンボタンで撮影できる写真です。さまざまなモードや機能を有効にする必要なく、すぐに体験ができます。

これは、これらのデバイスが採用している計算手法のおかげです。Pixelカメラとソフトウェアは、カメラ設定について多くのことを考える必要なく、満足のいく結果を得るように設計されています。合成フィルフラッシュは、被写体が逆光であると自動的に作動し、ズームするとSuper Resolutionが自動的に起動します。

これらのテクノロジーはあなたがカメラを意識せずにその瞬間に集中できるようにします

カメラが興味のある行動を検出すると、Motion photosは自動的にオンになり、貴方がシャッターボタンを押す前の瞬間であっても、AIが一連の写真の中から自動的に最高のベストショットを提案してきます。

オートフォーカスは、通常、人間の被験者に非常に信頼性の高い焦点を当てていますが、被写体を指定する必要がある場合は、それをタップするだけで、Motion Autofocusは追跡し続け、かなりの信頼性をもって被写体に焦点を当てます。これは幼児やペットを撮影する際に最適です。

このベストショットテクノロジーにより、これらの技術はあなたが写真を意識せずにその瞬間に集中する事、そして楽しむことさえ可能にするでしょう。時にはPixel 3がなければ逃してしまったかもしれない思い出を捉えるのに役立ちます。

今後もPixel 3を特集する予定ですので、楽しみにお待ちください。その間、あなたの好きなPixel 3の機能が何であるか、Pixel 3の機能でテストして欲しい機能は何かを下記コメント欄でお知らせください。

3.Google Pixel 3が突破したデジタルカメラの5つの限界(2/2)関連リンク

1)www.dpreview.com

5 ways Google Pixel 3 camera pushes the boundaries of computational photography

コメント