1.Nested Hierarchical Transformer:ViTに数行のコードを加えるだけでデータ効率を大幅に向上(2/3)まとめ

・Nested Hierarchical Transformerは各ノードが持つ情報が重複していないので解釈が用意

・階層構造の上から下へ辿って分類結果に最も貢献した箇所を視覚化するGradCAT手法を提案

・分類結果が正しくともモデルが注目した箇所が誤っている事例などが明白にわかる

2.GradCATとは?

以下、ai.googleblog.comより「Nested Hierarchical Transformer: Towards Accurate, Data-Efficient, and Interpretable Visual Understanding」の意訳です。元記事は2022年2月9日、Zizhao Zhangさんによる投稿です。

アイキャッチ画像のクレジットはPhoto by Edvard Alexander Rølvaag on Unsplash

解釈可能性

このアーキテクチャは、各ノードで独立した、重複しない情報処理メカニズムです。この設計は決定木のような構造に似ており、木の各ノードには親ノードが受信した画像ブロックの情報が重複せずに独立して含まれているため、明白に解釈する事ができます。

また、各ノードを通過する情報の流れを追跡することで、各特徴表現の重要度を把握することができます。また、階層構造により画像の空間構造をネットワーク全体で保持し、解釈に有効な空間特徴表現マップを学習することができます。以下では、2種類の視覚的解釈可能性を紹介します。

まず、学習したモデルをテスト画像上で解釈する方法として、GradCAT(gradient-based class-aware tree-traversal)と呼ぶ方法を紹介します。

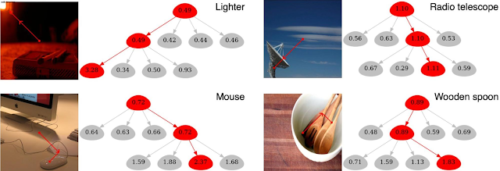

GradCATは、各ブロック(木のノード)の特徴量の重要度を、階層構造の上から下へ辿っていくものです。主なアイデアは、最上層のルートノードから最下層の子ノードまで、分類結果に最も貢献する最も価値のある探索を見つけることです。各ノードは画像の特定の領域の情報を処理するため、そのような探索木は解釈するために画像空間に容易にマッピングすることができます(下の画像に重ねた点と線で示すように)。

以下は、左の入力画像(4匹の動物を含む)に対する、モデルの上位4つの予測とそれに対応する解釈可能性の結果の例です。下図のように、GradCATは階層構造に沿った決定経路と、画像上の局所的な画像領域における対応する視覚的手がかりをハイライト表示します。

左の入力画像を分類する際に最も影響を与えた断片を可視化した図

探索木は、ツリーに沿ってモデルの決定経路を見つけると同時に、予測されたターゲットクラスへの影響が最も大きい対応する画像断片(画像の点で示します)を見つけることができます。

さらに、以下の図はImageNet検証セットでの結果を可視化したもので、この手法によって直感的な観察が可能になったことを示しています。

例えば、下のライターの例(左上図)は特に興味深いもので、本当に分類したいクラス(ライター/マッチ棒)は実際には右下のマッチ棒オブジェクトであるのに対し、最も顕著な視覚特徴(最高ノード値を持つ)は実際には左上の赤いライトである事が示されています。これは概念的にライターと視覚手がかりを共有しているからです。

これは、画像と重ね合わせた赤い線からもわかります。赤い線は予測に最も影響を与えた画像断片、すなわち右上を示しています。このように、視覚的な手がかりは間違いなのですが、出力された分類予測は正しいものとなっています。

また、右下の木製スプーンの4つの子ノードは、特徴の重要度が同じくらいです。(ノード内に記載された数値を参照。数値が高いほど重要度が高いことを示しています)。これは、テーブルの木の質感がスプーンの質感と似ているためです。

紹介したGradCATで得られた結果の可視化

画像はImageNet検証データセットのものです。

3.Nested Hierarchical Transformer:ViTに数行のコードを加えるだけでデータ効率を大幅に向上(2/3)関連リンク

1)ai.googleblog.com

Nested Hierarchical Transformer: Towards Accurate, Data-Efficient, and Interpretable Visual Understanding

2)arxiv.org

Nested Hierarchical Transformer: Towards Accurate, Data-Efficient and Interpretable Visual Understanding

3)github.com

google-research / nested-transformer