1.ロボット工学におけるA/Bテストの重要性の検証(2/2)まとめ

・制御された単純な環境で行う実験であっても意図せず現実世界の変動の影響を受ける

・ランダム割り当てでデータをランダムにグループ化するとA/Bテストを実現できる

・相対パフォーマンスが重要であり統計的差異を測定すると再現性を持つ実験が可能

2.ランダム割り当ての有効性

以下、ai.googleblog.comより「The Importance of A/B Testing in Robotics」の意訳です。元記事は2021年6月10日、Arnab BoseさんとYuheng Kuangさんによる投稿です。

ランダム割り当て(Random assignment)は「無作為割り当て」と訳される事もあるようですが、何故かしっくりこなかったので「ランダム割り当て」としました。コンピューターサイエンスの世界だと真のランダムって実現が難しい事が多々あり、そこに「作為(人が自分の意志で作り出すこと)」が必要だからでしょうか。

アイキャッチ画像のクレジットはPhoto by Vladislav Babienko on Unsplash

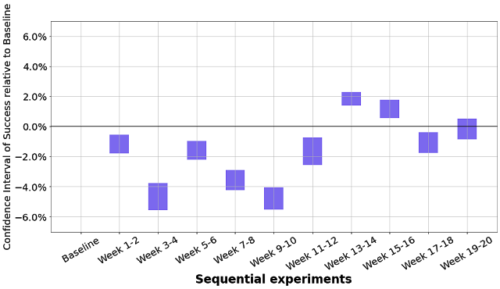

y軸は、比較対象基準に対する成功率の変化率(95%信頼区間)を表します。信頼区間内に0.0%の軸が含まれている場合、それは成功率が比較対象基準の成功率と統計的に類似していることを示します。信頼区間は、オペレーターの主観を取り除くためにJackknifeとCochran-Mantel-Haenszel補正を使用し計算されました。

上図のグラフデータを使用すると、モデルは13~14週にベストのパフォーマンスで実行され、9~10週で最低のパフォーマンスで実行されたと結論付けることができます。

また、上記の信頼区間のすべてではないにしてもほとんどが0を含むと予想したかもしれませんが、含まれたのは1つだけでした。これらのトライアル中は全く変更が行われなかったため、この事例は、非常に単純な環境でさえ、意図せず現実世界の変動の影響を受ける事を効果的に示しています。

また、実験ごとに試行回数を増やしてもこれらの違いはなくなるわけではなく、信頼区間が狭くなり、影響がより明確になる可能性が高いことにも注意してください。

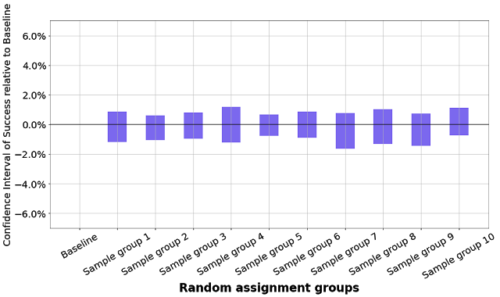

ここで、ランダム割り当て手法(Random assignment)を使用して結果を比較するとどうなるでしょう?つまり、データを順番にグループ化するのではなくランダムにグループ化するとどうなりますか?

これに答えるために、比較対象基準と比較するために、上記のデータを同じ数のランダムなグループに割り当てました。これは、A/Bテストで全てのグループに同じ扱いをするのと同じ事です。

グラフを見ると、信頼区間に0が含まれていることがわかります。これは、予想どおり、比較対象基準と成功率が似ている事を示しています。

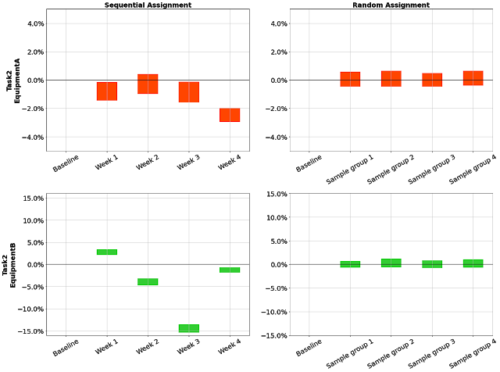

順次割り当て(sequential assignment)とランダム割り当てを比較するため、他のいくつかのロボットタスクで同様の研究を行いました。それらはすべて同様の結果をもたらしました。

意図的な変更がなくても、順次割り当てでは統計的に有意な差が観察されますが、ランダム割り当てでは統計的に有意な差がないという期待された通りの結果が示されます。

ロボット工学においてA/Bテストを実行する際の考慮事項

上記の結果に基づいて、ランダム割り当てを使用したA/Bテストが、ロボット工学における現実世界の説明できない変動を制御する効果的な方法であることは明らかですが、このアプローチを採用する際にはいくつかの考慮事項があります。以下に、いくつかの長所、短所、および解決策を示します。

(1)絶対パフォーマンスと相対パフォーマンス

各実験は、同時に実行された比較対象基準に対して測定する必要があります。比較対象基準と実験の間の相対的なパフォーマンス指標は、信頼区間として公開されます。(比較対象基準、または各実験における)絶対パフォーマンス指標は、測定が行われたときの世界の状態にある程度依存するため、あまり有益ではありません。しかし、各実験と比較対象基準の間で測定した統計的差異は健全であり、再現に対して堅牢です。

(2)データ効率

このアプローチでは、比較対象基準は常に実験と並行して実行する必要があります。これにより、相互に比較することができます。これは無駄に思えるかもしれませんが、過去の古い比較対象基準に対して無効な推論を行うことの欠点と比較すると、コストに見合う価値があります。更に、ランダム割り当て実験の規模を拡大すると、Googleが持つ重複する実験インフラストラクチャを活用して、個々の実験を行う際に単一の比較対象基準アームと複数の実験用アームを使用する事ができます。データ効率は規模とともに向上します。

(3)環境による偏り

パフォーマンス全体に影響を与える外部要因(照明、滑らかな表面など)があっても、比較対象基準時とすべての実験時に使ったアームの両方が同様の確率でこの要因に遭遇するため、相対的な影響がない場合、その影響は無視できます。環境要因と実験時に使ったアームの間に相関関係がある場合、これは時間の経過に伴う違いとして表示されます。(各環境要因は収集されたエピソード内に蓄積されます)。これにより、手間のかかる環境リセットの必要性を大幅に削減または排除でき、実験アームの耐用期間にわたって実験を実行しながら、実験アーム全体の改善を測定できます。

(4)人間による偏り

ランダム割り当て手法の利点の1つは、人間によってもたらされる偏りの減少です。人間のオペレーターは、どのデータサンプルがどの実験アームにルーティングされるかを知ることができないため、特定の実験者が特定の結果に影響を与えることは困難です。

前に続く道

A/Bテスト実験フレームワークは、変化する予測不可能な現実世界の環境に対するパフォーマンスを測定するために、多くの科学分野で長い間成功裏に使用されてきました。本ブログ投稿では、ロボット工学の研究がこれと同じ方法論を使用することで利益を得ることができることを示しています。これにより、研究結果の品質と信頼性が向上し、根本的に変化する現実環境のすべての要素を完全に制御するという不可能な作業が回避できます。これをうまく行うには、ロボットを継続的に操作し、データを収集し、研究者が統計フレームワークに簡単にアクセスできるようにするためのツールを備えたインフラストラクチャが必要です。

謝辞

Arnab Bose, Tuna Toksoz, Yuheng Kuang, Anthony Brohan, Razvan Sudulescuが実験インフラストラクチャを開発し、研究を実施しました。Matthieu Devinは、既存のデータを使用して違いを示すためにA/A分析を提案しました。研究に貴重なフィードバックとサポートを提供してくれたBill Heavlin, Chris Harris, Vincent Vanhoucke に特に感謝します。

3.ロボット工学におけるA/Bテストの重要性の検証(2/2)関連リンク

1)ai.googleblog.com

The Importance of A/B Testing in Robotics

2)research.google

Overlapping Experiment Infrastructure: More, Better, Faster Experimentation